-

Research Article

-

Numerical analysis of frequency dependent propagation characteristics of operational underwater noise from offshore wind turbines

해상풍력터빈 운전 수중소음의 주파수 의존 전파 특성에 대한 수치적 분석

-

Gwang-Se Lee, Eunkuk Son, Songjune Lee, Sangheon Lee, and Cheolung Cheong

이광세, 손은국, 이송준, 이상헌, 정철웅

- This study numerically investigates the frequency-dependent propagation behavior of operational underwater noise from offshore wind turbines using a coupled vibro–acoustic framework. Structural …

본 연구에서는 해상풍력 운전 시 발생하는 수중방사소음의 주파수 의존 전파 거동을 진동–음향 연성 수치해석을 통해 분석하였다. 공력 하중에 의해 유발되는 구조 가진을 …

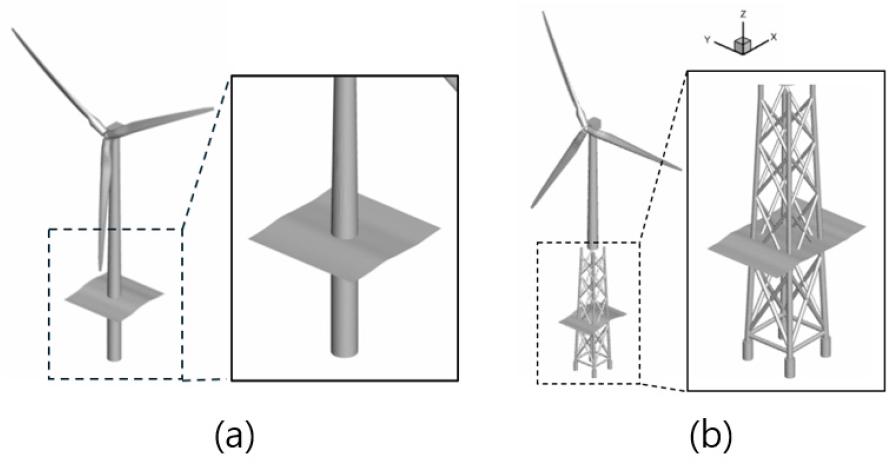

- This study numerically investigates the frequency-dependent propagation behavior of operational underwater noise from offshore wind turbines using a coupled vibro–acoustic framework. Structural excitation induced by aerodynamic loads was defined, and the dynamic responses obtained from finite element analysis were linked to an acoustic model representing the surrounding marine environment. Transmission Loss (TL) was evaluated over the frequency range of 10 Hz – 200 Hz, and variations in propagation characteristics associated with substructure configurations and frequency bands were examined. In addition, spatial sound field distributions were analyzed to explore factors influencing the observed propagation trends. The results highlight the importance of incorporating both structural and frequency-dependent features in predicting underwater noise from operating wind turbines and provide useful information for future large-scale wind farm assessments.

- COLLAPSE

본 연구에서는 해상풍력 운전 시 발생하는 수중방사소음의 주파수 의존 전파 거동을 진동–음향 연성 수치해석을 통해 분석하였다. 공력 하중에 의해 유발되는 구조 가진을 정의하고, 유한요소 기반의 구조 응답을 음향 해석과 연계하여 주변 해역의 음압 분포를 산정하였다. 10 Hz – 200 Hz 범위에서 거리 증가에 따른 전달손실(Transmission Loss, TL)을 평가하고, 하부구조 형상과 주파수 대역 변화에 따른 전파 특성의 차이를 비교하였다. 또한 공간 음장 분포를 함께 분석하여 전파 거동에 영향을 미치는 요인을 검토하였다. 본 연구는 해상풍력 운전 소음의 예측 과정에서 주파수 및 구조 특성을 함께 고려할 필요성을 제시하며, 향후 단지 규모 소음 평가를 위한 기초 자료로 활용될 수 있을 것으로 기대된다.

-

Numerical analysis of frequency dependent propagation characteristics of operational underwater noise from offshore wind turbines

-

Research Article

-

Research on the fabrication of ultra miniature signal transmission nodes for thin line array sensors

초세장형 선배열센서를 위한 초소형 신호전송노드 제작 기술 연구

-

Hyungjoon Choi, Seungho Choi, Junki Heo, and Jeongeun Yang

최형준, 최승호, 허준기, 양정은

- Towed linear array sensors offer excellent long-range, low-frequency underwater detection performance but generate hydrodynamic drag during towing, which reduces platform maneuverability. For …

예인형 선배열센서는 장거리 저주파 수중 탐지에 우수한 성능을 제공하지만, 예인 과정에서 유체 항력이 발생하여 플랫폼의 기동성이 저하되는 문제가 있다. 특히 무인 잠수정이나 …

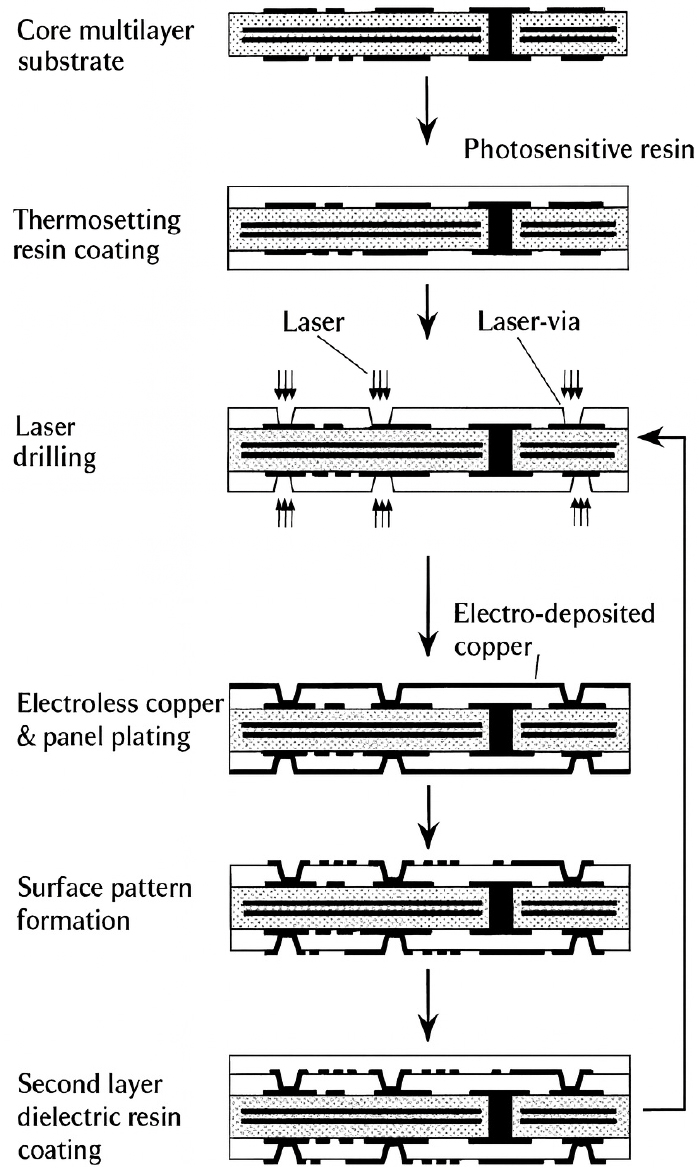

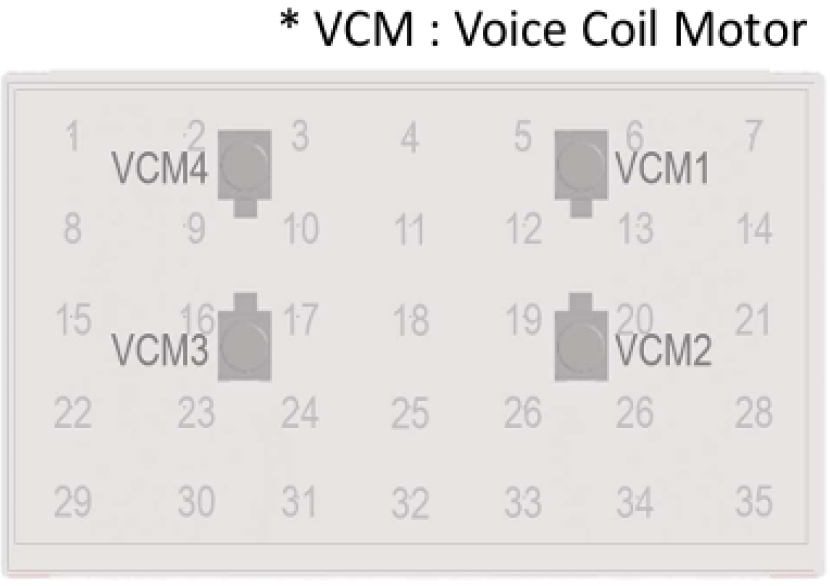

- Towed linear array sensors offer excellent long-range, low-frequency underwater detection performance but generate hydrodynamic drag during towing, which reduces platform maneuverability. For small platforms such as unmanned underwater or surface vehicles, minimizing drag requires ultra-slim array structures. Achieving such miniaturization demands high-density circuit design, compact component integration, and reduced signal interference and cabling, all of which introduce significant engineering challenges. In this study, we developed ultra-miniature signal transmission nodes that can be placed within a diameter of 30 mm, applying a build-up Printed Circuit Board (PCB) process for circuit integration and adopting a multi-hop network architecture to reduce internal wiring. These techniques enabled efficient spatial utilization within the constrained diameter of the array module, and the ultra-miniature signal transmission nodes were evaluated through electrical performance tests to verify performance optimization and confirm its practical applicability.

- COLLAPSE

예인형 선배열센서는 장거리 저주파 수중 탐지에 우수한 성능을 제공하지만, 예인 과정에서 유체 항력이 발생하여 플랫폼의 기동성이 저하되는 문제가 있다. 특히 무인 잠수정이나 무인 수상정과 같은 소형 플랫폼에서는 항력을 최소화하기 위해 초세장형 배열 구조가 요구된다. 이러한 소형화를 실현하기 위해서는 고밀도 회로 설계, 정밀한 부품 집적, 신호 간섭 및 배선 감소 등이 필요하며, 이는 다양한 엔지니어링적 도전 요소를 포함한다. 본 연구에서는 회로 집적화를 위해 다층 인쇄회로기판(build-up Printed Circuit Board, PCB)공정을 적용하고, 내부 배선을 줄이기 위해 다중 홉 네트워크(Multi-Hop Network) 아키텍처를 도입한 직경 30 mm 이내 배치 가능한 초소형 신호전송노드를 개발하였다. 이러한 기술들은 제한된 직경 내에서 효율적인 공간 활용을 가능하게 하였으며, 제작된 초소형 신호전송노드는 전기적 성능 시험을 통해 성능 최적화 및 실용성이 검증되었다.

-

Research on the fabrication of ultra miniature signal transmission nodes for thin line array sensors

-

Research Article

-

A study on ultrasonic call robust to drone noise

드론 잡음에 강인한 초음파 탐지 소리에 관한 연구

-

Sangwook Park

박상욱

- Recent demand for indoor autonomous navigation of drones has increased, drawing attention to ultrasonic-based obstacle detection. This paper experimentally investigates how motor-output-dependent …

최근 드론의 실내 자율주행 기술 수요가 증가함에 따라 초음파 기반 장애물 탐지 기술이 주목받고 있다. 본 논문은 드론의 모터 출력에 따른 잡음 …

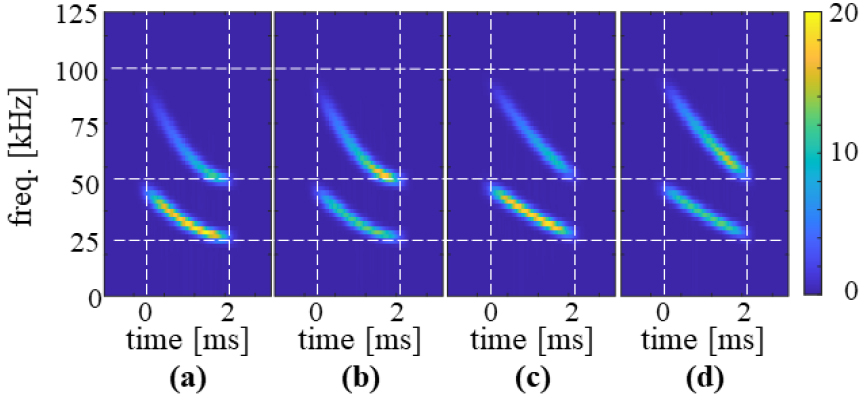

- Recent demand for indoor autonomous navigation of drones has increased, drawing attention to ultrasonic-based obstacle detection. This paper experimentally investigates how motor-output-dependent noise characteristics and call-sound design affect ultrasonic detection performance in a drone environment, and provides guidelines for signal processing and call-sound design. Bat-inspired call sounds are designed, and echoes from a transparent reflector are recorded under a medium-size drone with 0.18 m propellers. Data are collected by varying the motor output (20 %, 40 %, 50 %) and the reflector distance(0.5 m – 2.0 m). Echoes are detected using matched filtering and adaptive thresholding, and detection performance is evaluated. The results show that concentrating signal energy on the second frequency-modulated component achieves about 80 % detection accuracy at 2.0 m under the 40 % motor-output condition. As motor output increases, broadband noise becomes stronger and degrades echo detectability, leading to limited detection at high output. These findings indicate that allocating signal energy to avoid harmonic noise bands and adopting flight-condition-dependent ultrasonic sensing are important for robust operation.

- COLLAPSE

최근 드론의 실내 자율주행 기술 수요가 증가함에 따라 초음파 기반 장애물 탐지 기술이 주목받고 있다. 본 논문은 드론의 모터 출력에 따른 잡음 특성과 탐지 소리 설계가 초음파 탐지율에 미치는 영향을 실험적으로 분석하여, 드론 환경에서의 초음파 기반 탐지 신호처리 설계 방향을 제시한다. 먼저 박쥐의 생체 소나 신호를 모사한 초음파 탐지 소리를 설계하고, 0.18 m 프로펠러가 탑재된 중형 드론 환경에서 투명 반사판으로부터 반사음을 수집한다. 모터 출력(20 %, 40 %, 50 %)과 반사판 거리(0.5 m – 2.0 m)를 변화시키며 데이터를 확보하고, 수집 신호에 정합 필터와 적응적 임계 검출을 적용하여 반사음을 검출한 뒤 탐지 성능을 평가한다. 실험 결과, 탐지 소리의 에너지 분포가 2차 주파수 변조 요소에 상대적으로 크게 집중된 경우, 모터 출력 40 % 조건에서 2.0 m 거리에서도 약 80 %의 탐지 정확도를 보여준다. 동시에 모터 출력이 증가할수록 광대역 잡음이 증가하여 탐지 소리 검출이 제한됨을 보여준다. 이는 드론의 고조파 잡음 대역을 회피하여 탐지신호 에너지를 분포시킴으로써 드론 환경에 강인한 탐지율을 기대할 수 있고, 모터 출력에 따라 선택적인 초음파 탐지 전략이 필요함을 시사한다.

-

A study on ultrasonic call robust to drone noise

-

Research Article

-

Method for minimizing display haptic noise

디스플레이 햅틱 소음 저감을 위한 방법

-

Saseong Moon and Hyejin Bae

문사성, 배혜진

- In recent years, the automotive industry has increasingly adopted large displays to replace physical buttons, drawing attention to touch and haptic technologies. …

최근 자동차 산업에서는 대형 디스플레이가 물리 버튼을 대체하며 터치 및 햅틱 기술이 주목받고 있다. 저주파 햅틱 기술, 특히 저주파 굽힘파 원리를 활용한 …

- In recent years, the automotive industry has increasingly adopted large displays to replace physical buttons, drawing attention to touch and haptic technologies. While low-frequency haptic technologies, particularly those based on the bending wave principle, are widely used, they have been criticized for generating noise. This noise arises because vibrations from the display radiate sound, causing discomfort. In this study, we explored a method to implement haptic feedback through vibration motors upon touch, maximizing vibration at the touch point while minimizing overall noise. To achieve this, we defined a new index called the Haptic Noise Index (HNI) to select optimal frequencies, identifying the frequency with the lowest HNI. The HNI is defined as the ratio of vibration at the touch point to the Equivalent Radiated Power (ERP). Additionally, we adjusted the phase of the vibration motors, treated each motor’s vibration contribution as a design variable, and used HNI as the objective function for optimization. By applying this approach, we successfully reduced noise at specific touch locations. The optimization was performed using an Sequential Quadratic Programming (SQP) algorithm. As a result, we achieved noise reduction of over 10 dB compared to signals without the application of this method.

- COLLAPSE

최근 자동차 산업에서는 대형 디스플레이가 물리 버튼을 대체하며 터치 및 햅틱 기술이 주목받고 있다. 저주파 햅틱 기술, 특히 저주파 굽힘파 원리를 활용한 기술이 주로 사용되지만, 이로 인해 발생하는 소음이 문제로 지적되고 있다. 디스플레이의 진동이 음향을 방사하여 불쾌한 소음을 유발하기 때문이다. 본 연구에서는 터치 시 진동 모터를 통해 디스플레이 패널에서 햅틱을 구현하고, 터치 지점의 진동을 극대화하면서 전체 소음을 최소화하는 방법을 모색하였다. 이를 위해 Haptic Noise Index(HNI)라는 지표를 정의하여 주파수를 선정하고, HNI가 가장 낮은 주파수를 조사하였다. HNI는 터치 지점의 진동과 Equivalent Radiated Power(ERP)의 비율로 정의된다. 또한 진동 모터의 위상을 조정하고 각 모터의 진동 기여도를 설계변수로 설정하였으며, HNI를 목적함수로 선정하여 최적화를 수행함으로써 특정 터치위치에서의 소음을 저감하였다. 이 과정에서 Sequential Quadratic Programming(SQP) 방법을 활용하였다. 결과적으로 본 연구가 적용되지 않은 신호 대비 소음을 10 dB이상 저감하였다.

-

Method for minimizing display haptic noise

-

Research Article

-

Structural topology optimization considering temperature dependent Young’s modulus of polymersc

온도에 따라 변화하는 고분자의 영률을 고려한 구조 위상 최적화에 관한 연구

-

Seongwon Bae, Sunghoon Lim, Kozo Furuta, Kazuhiro Izui, and Shinji Nishiwaki

배성원, 임성훈, 후루타코조, 이주이카즈히로, 니시와키신지

- Polymers, along with metals, are most widely used as structural materials for air conditioners. Polymers are lightweight and have low thermal conductivity, …

폴리머는 금속과 함께 에어컨의 구조 재료로 가장 널리 사용되는 소재입니다. 고분자 물질은 가볍고 열전도도가 낮으며 외관이 반짝이는 특성이 있어서, 뜨겁거나 차가운 표면으로부터 …

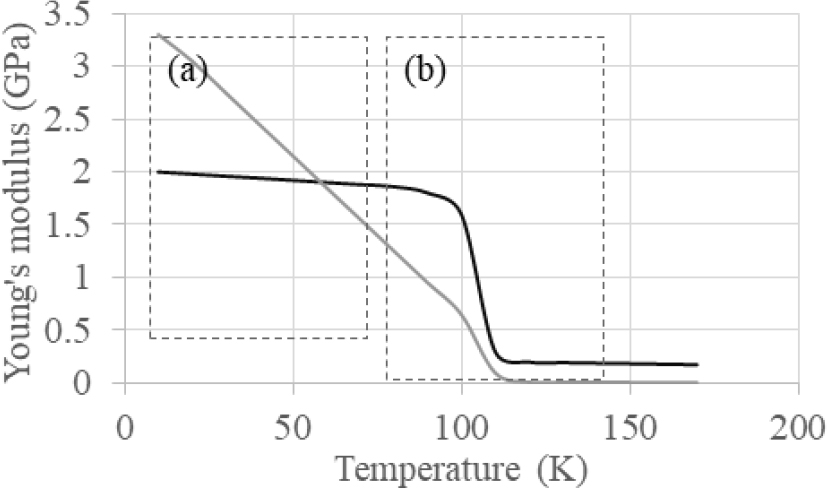

- Polymers, along with metals, are most widely used as structural materials for air conditioners. Polymers are lightweight and have low thermal conductivity, so they are used to protect customers from hot or cold surfaces, reduce weight, and improve appearance. However, structural properties such as the Young’s modulus of the polymer are temperature dependent, which changes significantly as it approaches the melting point or glass transition temperature. Operating the air conditioner for winter heating can heat-deform the polymer and cause loud squeaking noise due to friction deformation motion. To solve this problem, Young’s modulus, which depends on temperature, is expressed as a simplified function and a topology optimization model using it is proposed. In addition, the usefulness is demonstrated by performing structural phase optimization for static and dynamic problems and multi objective problems with both items using this model.

- COLLAPSE

폴리머는 금속과 함께 에어컨의 구조 재료로 가장 널리 사용되는 소재입니다. 고분자 물질은 가볍고 열전도도가 낮으며 외관이 반짝이는 특성이 있어서, 뜨겁거나 차가운 표면으로부터 고객을 보호하고 제품의 무게를 줄이며 외관을 개선하는 데 사용됩니다. 그러나 이 고분자는 소재의 온도가 녹는점이나 유리화 온도에 가까이 가는 등 온도 변화가 심할 때 온도에 따라 영률과 같은 구조적 물성이 변화합니다. 겨울철 난방을 위해 에어컨을 가동하면 폴리머가 열에 의해 변형되고 상대적 변형에 의한 마찰 운동에 의해 삐걱거리는 소음이 크게 발생할 수 있습니다. 이 문제를 해결하기 위해 온도에 따라 달라지는 영률을 단순화된 함수로 표현하고 이를 이용한 토폴로지 최적화 모델을 제안합니다. 또한, 이 모델의 유용성을 보이기 위하여 정적 및 동적 문제 그리고 두 문제를 혼합한 다목적 문제에 대한 구조적 위상 최적화를 수행하였습니다.

-

Structural topology optimization considering temperature dependent Young’s modulus of polymersc

-

Research Article

-

Towards classroom acoustic standard in Korea considering occupied acoustic conditions

재실 음향 특성을 반영한 국내 교실 음향 기준 제안

-

Young-Ji Choi

최영지

- This study aims to provide data for establishing acoustic standards in Korean school classrooms by analyzing the results of an acoustic survey …

본 연구의 목적은 국내 초·중·고등학교 및 대학교에 위치한 총 49개 교실과 강의실, 106개 수업 현장에서 수행한 공실 및 재실 음향 측정 결과를 …

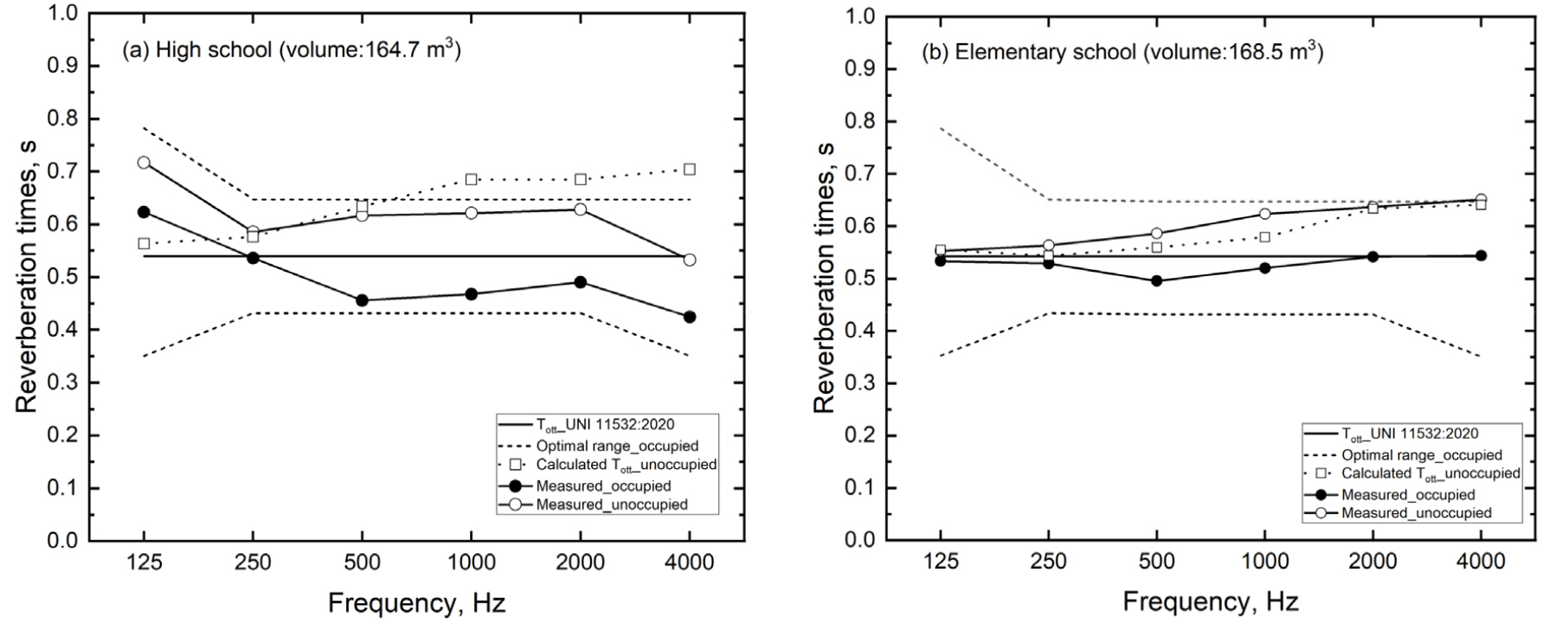

- This study aims to provide data for establishing acoustic standards in Korean school classrooms by analyzing the results of an acoustic survey conducted in 49 classrooms and lecture rooms across elementary, junior high, high schools, and universities, totaling 106 active classes. The findings indicate that in spaces where speech intelligibility is critical, acoustic design should not be limited to unoccupied room conditions but must incorporate occupied conditions reflecting students and teaching activities to ensure adequate speech intelligibility. Based on the acoustic measurement results of classrooms and lecture rooms, the recommended reverberation time for spaces with a volume of 250 m3 or less is 0.60 s at 125 Hz – 4 kHz, with a range of 0.48 s to 0.72 s depending on the number of people in the room. To enable teachers to maintain an appropriate Speech to Noise Ratio (SNR) value without unnecessarily raising their voice levels during class, the maximum noise level in an unoccupied room is LAeq ≤ 40 dBA (the air conditioner is running). To minimize noise from adjacent classrooms during class activities, the wall's sound insulation performance should be STC ≥ 50 for adjacent classrooms and STC ≥ 45 for adjacent corridors. In areas where speech privacy is important, such as in a combined wall with a corridor, the STC should be ≥ 50. To achieve a speech intelligibility of Speech Transmission Index (STI) ≥0.60 and U50 ≥4.1 dB, the recommended SNR value of ≥15 dBA, and a C50 of ≥4 dB should be met. In this study, only 5 % of the 106 classrooms were from special schools. Therefore, when establishing acoustic standards for educational facilities, it is necessary to consider not only general schools, but also special schools that require acoustic support.

- COLLAPSE

본 연구의 목적은 국내 초·중·고등학교 및 대학교에 위치한 총 49개 교실과 강의실, 106개 수업 현장에서 수행한 공실 및 재실 음향 측정 결과를 바탕으로 교육시설 음향 기준을 제정하기 위한 기초 자료를 마련하는 것이다. 연구 결과, 음성 전달이 중요한 공간에서는 공실 상태의 음향 기준에만 의존하지 않고, 재실자와 수업 활동을 반영한 재실 음향 설계를 고려해야만 적절한 음성 명료도를 확보할 수 있음을 확인하였다. 국내 교실 및 강의실의 실내 음향 측정 결과를 바탕으로, 체적 250 m3 이하의 공간에 대한 권장 잔향 시간은 재실 80 % 기준 125 Hz – 4 kHz 대역에서 0.60 s ≤ Tott가 적절하며, 실내 재실 상태에 따라 상하 20 % 범위인 0.48 s ≤ Tott ≤ 0.72 s가 허용 범위이다. 교사가 수업 시 목소리 레벨을 무리하게 높이지 않고 적정 음성대 소음 비(Speech to Noise Ratio, SNR)값을 유지하기 위해 공실 최대 허용 소음 레벨은 LAeq ≤ 40 dBA(공조기 가동 시)가 적절하다. 인접한 교실 간 수업 활동에 의한 소음을 차단하기 위해 벽체 간 차음 성능은 인접 교실 STC ≥ 50, 인접 복도 STC ≥ 45가 적절하며, 복도와 인접한 복합 벽체의 경우 음성 프라이버시가 중요한 장소에서는 STC ≥ 50이 적절하다. 음성전달지수(Speech Transmission Index, STI) ≥0.60에 상응하는 음성 명료도 U50≥ 4.1 dB를 성취하기 위해, 수업 중 재실 음향 상태가 권장값인 SNR ≥15 dBA를 만족한다면, C50≥ 4 dB(재실 기준)가 요구된다. 본 연구에서는 총 106개 수업 현장 중 특수학교는 5 % 미만의 수업만을 대상으로 하여, 향후 교육시설 음향 기준 제정 시 일반 학교뿐만 아니라 음향적 지원이 필요한 특수학교의 재실 음향 특성까지 반영된 기준을 함께 제시할 필요가 있다.

-

Towards classroom acoustic standard in Korea considering occupied acoustic conditions

-

Research Article

-

Vibration characteristics analysis of barrel type cylindrical shells

베럴형 원통쉘의 진동특성 해석

-

Moojoon Kim and Jungsoon Kim

김무준, 김정순

- This paper presents an analytical study on the axisymmetric vibration characteristics of barrel-type cylindrical shells. Assuming that the shell thickness is sufficiently …

본 논문에서는 베럴형 원통쉘의 축대칭 진동 특성을 해석적으로 규명하였다. 쉘의 두께가 길이에 비해 충분히 얇다는 가정하에, 접선 방향 변위와 그에 수직한 법선 …

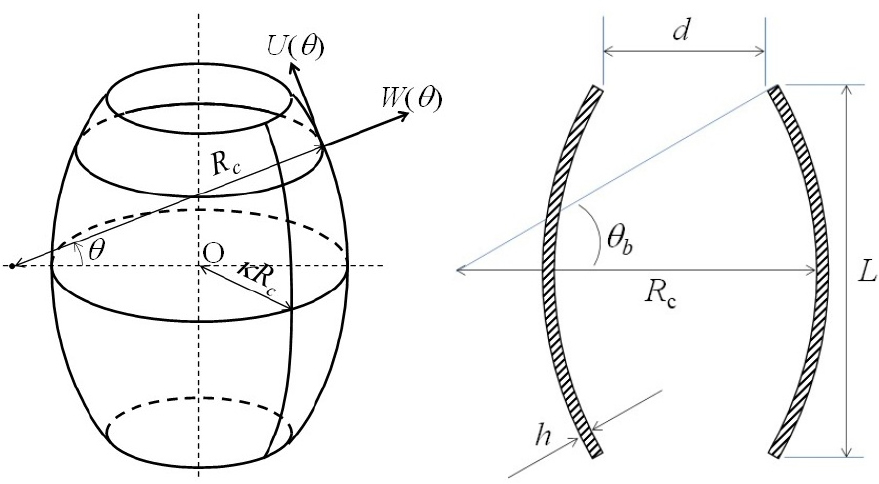

- This paper presents an analytical study on the axisymmetric vibration characteristics of barrel-type cylindrical shells. Assuming that the shell thickness is sufficiently small compared to its length, the torsional motion is neglected and two displacement components - normal displacement along the meridional curvature and tangential displacement along the meridian - are considered. The coupled governing equations are derived from the Lagrangian formulation and expressed as a set of ordinary differential equations. A power series expansion with respect to the angular coordinate is introduced to obtain general solutions, which are classified according to the parity of the displacement functions. Resonance conditions are derived in determinant form for clamped-clamped and simply supported boundary conditions. Natural frequencies and corresponding mode shapes are calculated, and the validity of the proposed analytical method is verified through comparison with finite element analysis. The results show good agreement overall. Furthermore, the effects of the surface curvature radius on resonance frequencies are investigated, revealing that the natural frequencies increase as the curvature radius increases for all vibration modes.

- COLLAPSE

본 논문에서는 베럴형 원통쉘의 축대칭 진동 특성을 해석적으로 규명하였다. 쉘의 두께가 길이에 비해 충분히 얇다는 가정하에, 접선 방향 변위와 그에 수직한 법선 방향 변위를 고려하여 라그랑지안으로부터 연립 상미분방정식을 유도하였다. 도출된 방정식은 각도에 대한 멱급수 해법을 적용하여 해석적으로 전개하였으며, 변위 함수의 기·우함수 특성에 따라 두 가지 경우로 구분하여 일반해를 구성하였다. 양단 고정 및 단순지지 경계조건에 대해 공진 조건식을 행렬식 형태로 유도하고, 이를 통해 고유진동수와 모드 형상을 계산하였다. 제안된 해석 방법의 타당성을 검증하기 위하여 유한요소해석 결과와 비교하였으며, 두 결과가 전반적으로 잘 일치함을 확인하였다. 또한 곡률반경 변화에 따른 공진주파수의 변화를 분석하여, 곡률반경 증가에 따라 모든 모드의 공진주파수가 증가함을 확인하였다.

-

Vibration characteristics analysis of barrel type cylindrical shells

-

Research Article

-

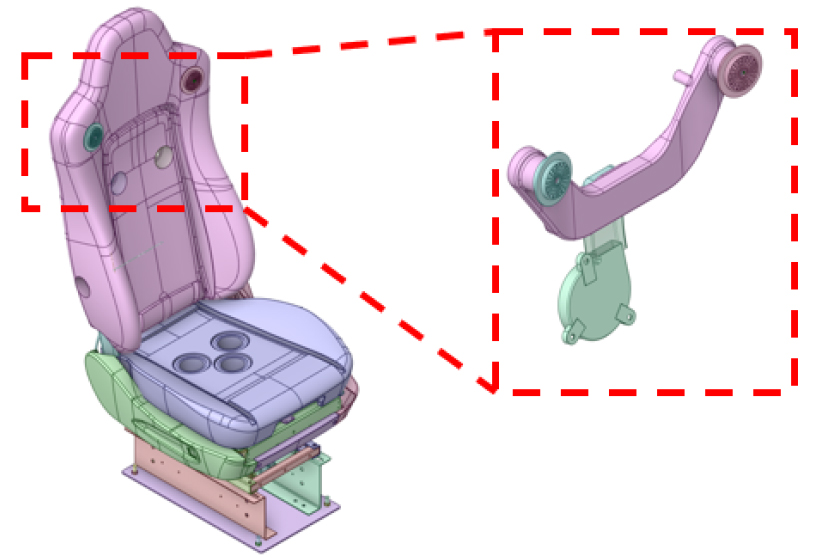

Numerical study on the optimization of oxygen delivery and flow performance for a ventilation system integrated into a vehicle seat

차량 시트 장착형 산소 환기 시스템의 산소 전달 및 유동 성능 최적화를 위한 수치해석적 연구

-

Sangjun Lee, Cheolung Cheong, and Ohhyoung Kwon

이상준, 정철웅, 권오형

- This study proposes a numerical optimization framework to improve the oxygen delivery and flow performance for a ventilation system integrated into a …

본 연구는 차량 시트 장착형 산소 환기 시스템을 대상으로 산소 전달 및 유동 성능 향상을 위한 수치해석 기반 최적화 설계 방법을 제안하였다. …

- This study proposes a numerical optimization framework to improve the oxygen delivery and flow performance for a ventilation system integrated into a vehicle seat. Computational Fluid Dynamics (CFD) simulations based on the multi-species incompressible Reynolds–Averaged Navier–Stokes (RANS) equations were performed, and the volume-averaged oxygen mole fraction in the breathing zone was used as the performance metric. The vertical and horizontal discharge angles were selected as design variables, and the optimal angles maximizing the breathing-zone oxygen mole fraction were determined using the Response Surface Method (RSM). In addition, adjoint-based sensitivity analysis was applied to optimize the flow path geometry for pressure-loss reduction. Numerical results show that the breathing-zone oxygen concentration increases by approximately 0.126 % compared with the baseline configuration when the optimal discharge angles are applied. Furthermore, the pressure loss is reduced by approximately 44.24 % through flow path shape optimization. Based on the fan affinity law, this pressure-loss reduction corresponds to an estimated fan noise reduction of approximately 6.33 dB under the same flow-rate condition. The proposed integrated framework demonstrates the feasibility of improving both oxygen delivery and flow efficiency and can be applied to the design of high-performance and low-noise automotive ventilation systems.

- COLLAPSE

본 연구는 차량 시트 장착형 산소 환기 시스템을 대상으로 산소 전달 및 유동 성능 향상을 위한 수치해석 기반 최적화 설계 방법을 제안하였다. 다성분 비압축성 Reynolds–Averaged Navier–Stokes(RANS) 방정식 기반 전산유체역학(Computational Fluid Dynamics, CFD) 해석을 수행하고, 호흡기 영역의 체적 평균 산소 농도를 성능 지표로 사용하였다. 토출구 수직 및 수평각도를 설계변수로 설정하고 반응표면법(Response Surface Method, RSM)을 통해 호흡기 영역 산소 농도가 최대가 되는 최적 토출각도를 도출하였다. 또한 유로 내부 압력손실을 목적함수로 설정하고 Adjoint 기반 민감도 해석을 적용하여 유로 형상 최적화를 수행하였다. 수치해석 결과, 최적 토출각도에서 호흡기 영역 산소 농도는 기준 대비 약 0.126 % 증가하였다. 유로 형상 최적화 결과 압력손실은 약 44.24 % 감소하였다. 또한 팬 상사법칙을 적용하면 동일 유량 조건에서 약 6.33 dB 수준의 소음 저감 효과가 예측된다. 본 연구에서 제안한 통합 설계 프레임워크는 차량용 환기 시스템의 고성능·저소음 설계에 활용 가능함을 확인하였다.

-

Numerical study on the optimization of oxygen delivery and flow performance for a ventilation system integrated into a vehicle seat

-

Research Article

-

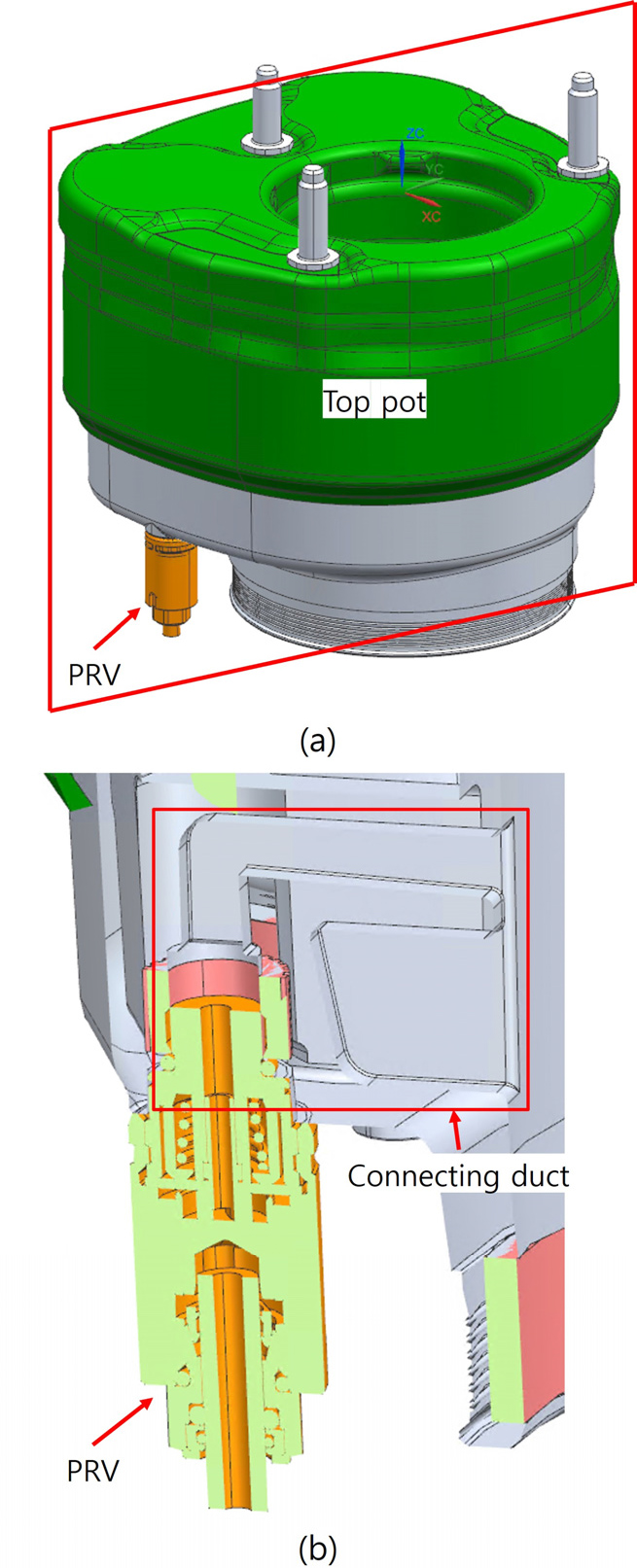

Characterization of fluid-borne vibration and radiated noise due to unsteady compressible flow in a pressure relief valve of an air suspension system

전자식 에어 서스펜션 압력방출밸브의 비정상 압축성 유동에 의한 유체기인 진동 및 방사소음 특성분석

-

Yonguk Lee, Kwongi Lee, Cheolung Cheong, Janghyun Oh, and Bongkeun Choi

이용욱, 이권기, 정철웅, 오장현, 최봉근

- As vehicle electrification enhances the demand for quietness, the Noise, Vibration, and Harshness (NVH) performance of Pressure Relief Valves (PRV) in air …

차량 전동화로 인한 정숙성 요구 증대에 따라 전자식 에어 서스펜션 압력방출밸브(Pressure Relief Valve, PRV)의 소음·진동·불쾌감(Noise, Vibration, and Harshness, NVH) 성능 확보가 중요해지고 …

- As vehicle electrification enhances the demand for quietness, the Noise, Vibration, and Harshness (NVH) performance of Pressure Relief Valves (PRV) in air suspension systems has become critical. This study develops an integrated flow-vibroacoustic analysis framework to predict Fluid-Borne Vibration (FBV) and radiated noise induced by unsteady compressible flow inside a PRV. Wall-pressure fluctuations are computed using 3D unsteady compressible Large Eddy Simulation (LES) and mapped onto a structural model for frequency-response and structural-acoustic coupled analysis. Short-Time Fourier Transform (STFT) is employed to characterize the time-varying spectral features of the discharge process. The predicted acceleration and sound pressure spectra show good agreement with experimental data, specifically capturing the broadband and quasi-tonal components during the initial transient phase. The proposed framework provides an effective tool for predicting and optimizing the NVH performance of electronic air suspension systems at the early design stage.

- COLLAPSE

차량 전동화로 인한 정숙성 요구 증대에 따라 전자식 에어 서스펜션 압력방출밸브(Pressure Relief Valve, PRV)의 소음·진동·불쾌감(Noise, Vibration, and Harshness, NVH) 성능 확보가 중요해지고 있다. 본 연구에서는 PRV 내부의 비정상 압축성 유동에 의한 유체기인 진동(Fluid-Borne Vibration, FBV) 및 방사 소음을 예측하기 위해 Large Eddy Simulation(LES) 기반의 유동–진동–음향 통합 해석 프레임워크를 구축하였다. 3차원 비정상 압축성 유동 해석을 통해 벽면 압력 섭동을 산출하였으며, 이를 구조 해석 모델에 매핑하여 주파수 응답 기반의 진동 및 구조–음향 연성 해석을 수행하였다. 또한, Short-Time Fourier Transform(STFT) 분석을 도입하여 배기 과정의 시간 가변적 특성과 과도 구간의 스펙트럼 특성을 규명하였다. 해석 결과는 실험 데이터와 양호한 일치를 보였으며, 특히 초기 배기 시 발생하는 광대역 및 준순음성 성분을 효과적으로 재현하였다. 본 연구에서 제안한 통합 해석 기법은 설계 초기 단계에서 PRV의 NVH 성능을 사전 예측하고 최적화하는 데 유용하게 활용될 것으로 기대된다.

-

Characterization of fluid-borne vibration and radiated noise due to unsteady compressible flow in a pressure relief valve of an air suspension system

-

Research Article

-

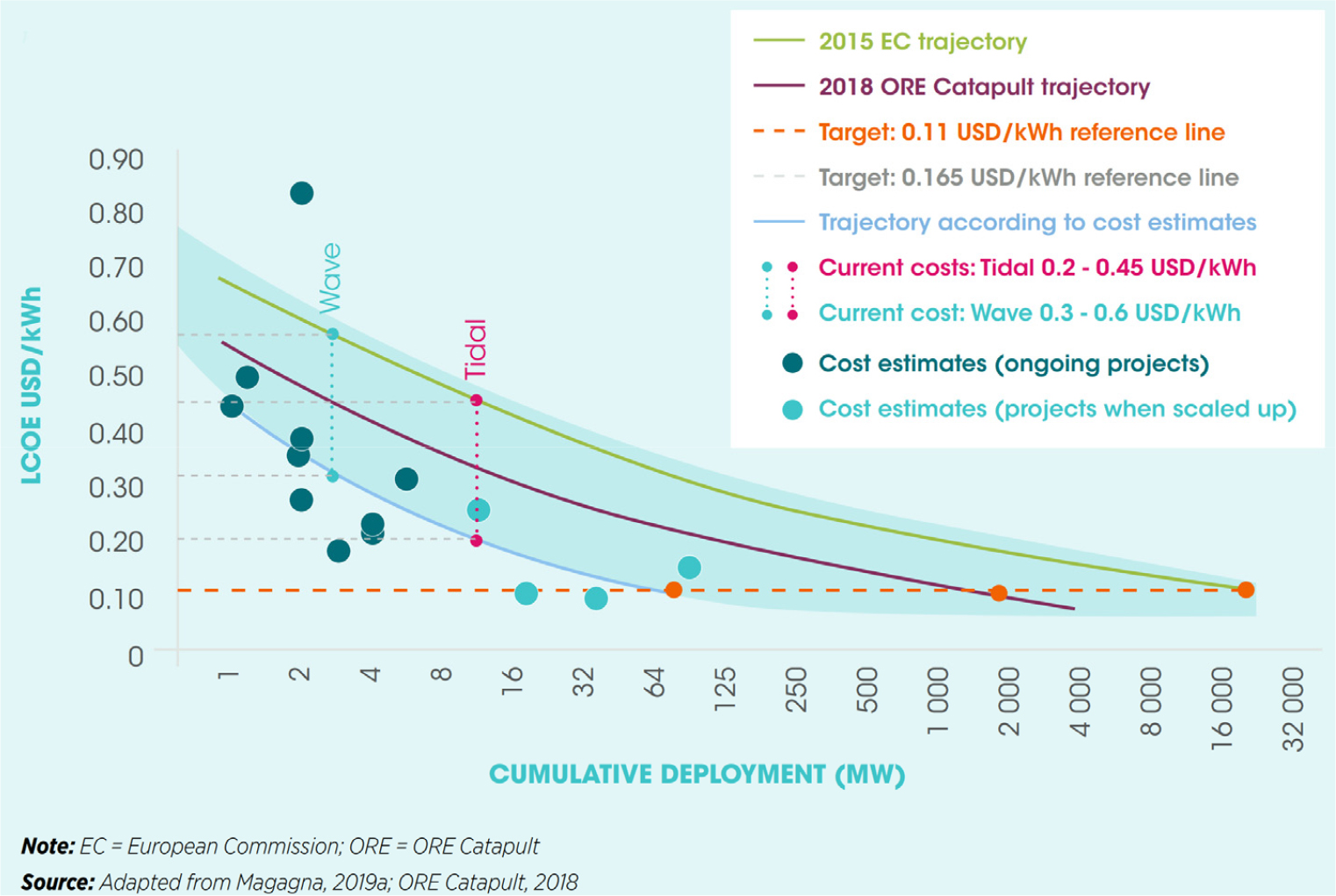

Experimental study on the performance enhancement of a marine current energy converter using flow induced motion

유동유발진동 현상을 활용한 해양조류에너지 발전장치 성능 향상을 위한 실험적 연구

-

Jun Kim, Yeon Kang Choi, Min Je Kang, Gyu In Shin, Young-Myung Choi, Yun-ho Shin, Hongrae Park, Eun Soo Kim, and Seunghoon Oh

김준, 최연강, 강민제, 신규인, 최영명, 신윤호, 박홍래, 김은수, 오승훈

- This paper experimentally investigates a sub-100 W class Flow-Induced Motion (FIM) energy converter prototype for low-velocity marine currents using towing-tank tests. Two …

본 논문은 저유속 조류 환경에서 유동유발진동(Flow-Induced Motion, FIM)을 이용하는 100 W급 이하 조류 에너지 변환 연구 프로토타입을 대상으로, 구동부 배치(Inner/Outer)와 실린더 종횡비 …

- This paper experimentally investigates a sub-100 W class Flow-Induced Motion (FIM) energy converter prototype for low-velocity marine currents using towing-tank tests. Two drivetrain configurations (Inner and Outer) and two cylinder aspect ratios were evaluated under identical conditions by measuring cross-flow vibration response, mechanical power, and conversion efficiency. In the Vortex-Induced Vibration (VIV) regime within the target operating range, the larger aspect-ratio cylinder generally produced higher mean power and efficiency, suggesting that an increased effective span enhances hydrodynamic performance. The two configurations showed different efficiency trends in VIV, while a clear difference in absolute power output was observed in the galloping regime. Overall, drivetrain-related response stability and dynamic characteristics directly influenced power generation and efficiency. These results provide practical guidelines for configuration selection and design of Flow-Induced Motion (FIM) based energy converters in low-speed tidal-current environments.

- COLLAPSE

본 논문은 저유속 조류 환경에서 유동유발진동(Flow-Induced Motion, FIM)을 이용하는 100 W급 이하 조류 에너지 변환 연구 프로토타입을 대상으로, 구동부 배치(Inner/Outer)와 실린더 종횡비 차이에 따른 조류에너지 변환 성능을 예인수조 실험을 통해 비교·분석하였다. 두 타입은 실린더 운동 전달 방식과 발전부 배치가 상이하며, 동일한 시험 조건에서 횡방향 진동 진폭, 주파수 특성, 기계적 동력 및 에너지 변환 효율을 계측하였다. 실험 결과, 설계 유속 범위에 해당하는 와류기인진동(Vortex-Induced Vibration, VIV) 영역에서는 종횡비가 큰 조건이 평균 동력과 효율 측면에서 전반적으로 유리한 경향을 보였으며, 이는 동일 직경 조건에서 유효 유체력 작용 길이 증가가 성능 향상에 기여할 수 있음을 시사한다. 한편 VIV 영역에서는 타입에 따라 효율 특성이 상이하게 나타났고, galloping 영역에서는 절대 동력 수준에서 뚜렷한 차이가 확인되었다. 특히 구동부 배치에 따른 운동 안정성 및 응답 특성의 차이가 동력 및 효율 특성에 직접적인 영향을 미치는 것으로 나타났다. 본 연구는 출력 성능 비교에 국한하지 않고, 실린더 거동응답 관점에서 구동부 배치 및 종횡비가 에너지 변환 특성에 미치는 영향을 함께 분석하였다는 점에서 의의를 가진다. 이러한 결과를 바탕으로 본 연구는 유속 범위 및 목표 출력 조건에 따른 Inner 타입과 Outer 타입의 선택 기준을 제시하며, 저유속 조류 조건에서의 유동유발진동(Flow-Induced Motion, FIM) 기반 에너지 변환장치 설계 및 운용을 위한 실험 기반 설계 지침을 제공한다.

-

Experimental study on the performance enhancement of a marine current energy converter using flow induced motion

Journal Informaiton

The Journal of the Acoustical Society of Korea

The Journal of the Acoustical Society of Korea

Journal Informaiton

Journal Informaiton - close

The Journal of the Acoustical Society of Korea

The Journal of the Acoustical Society of Korea