I. 서 론

II. 사운드 이벤트 검출 전체구조

2.1 스테레오 채널 기반의 오디오 특징 추출

2.2 게이트형 순환 신경망(GRNN)

III. 실 험

3.1 실험 데이터

3.2 측정 방식

3.3 실험 결과

IV. 결 론

I. 서 론

사운드 이벤트는 인간이 오디오 신호를 통해 감지 또는 구별할 수 있는 특정한 이벤트를 의미한다. 일상생활에서 발생하는 다양한 사운드 이벤트에 대한 검출은 산업 및 환경 감시 시스템, 스마트 홈과 같은 서비스를 제공할 수 있게 하는 중요한 기술이다.[1]

사운드 이벤트 검출은 크게 단성 사운드 검출과 다성 사운드 검출로 분류할 수 있다. 단성 사운드 검출은 사운드 신호에서 가장 두드러진 신호를 인식하는 것이고 다성 사운드 검출은 가장 두드러진 신호 외에 중첩되어 있는 모든 사운드 신호를 인식하는 것이다.[2] 지금까지의 다성 사운드 이벤트 검출 방식은 단일 채널 오디오 신호를 사용해왔다. 그러나 최근 자동 음성 인식에 대한 연구에서 다채널 오디오의 특징값을 사용할 경우 단일 채널의 특징값을 사용하는 경우보다 개선된 성능을 보이는 것이 확인되었다.[3]

또한 기존에 널리 사용되던 분류기나 신경망인 GMM(Gaussian Mixture Models), CNN(Convolutional Neural Networks), RBM(Restricted Boltzmann Machine) 등과 같은 모델들은 다수의 과제에 대해 성공적으로 동작하지만, 입력 신호의 시간적인 특성에 대해 제한적이라는 한계가 있다. 이에 신호의 시간적 특성을 반영할 수 있는 순환 신경망에 대한 연구가 활발히 진행되었다. 현재 가장 높은 성능을 보이는 장단기 기억(Long Short Term Memory, LSTM) 신경망 또한 이러한 순환 신경망 중 하나로 최근들어 많은 분야에서 널리 사용되고 있다. 하지만 LSTM은 내부 매개변수가 많아 복잡하며 학습 시간이 오래 걸린다는 단점이 있다. 이에 본 논문에서는 LSTM의 변형된 구조로써 내부 구조가 더욱 단순하며 변수가 적어 LSTM보다 학습시간이 짧게 걸리고 과적합이 덜 일어난다는 장점을 가진 게이트형 순환 신경망(Gated Recurrent Neural Networks, GRNN) 모델을 다성 사운드 이벤트 검출에 적용하여 다채널 오디오 특징값과 결합 된 사용을 제안한다.

본 논문의 구성은 다음과 같다. II장에서는 사운드 이벤트 검출을 위한 전체 신경망의 학습 및 인식 구조와 시스템에서 제안하는 복합적인 특징값에 대해 설명한다. III장에서는 성능 검증을 위한 실험 데이터베이스 및 측정 방식과 실험 결과를 제시한다. 마지막으로 IV장에서는 결론을 맺는다.

II. 사운드 이벤트 검출 전체구조

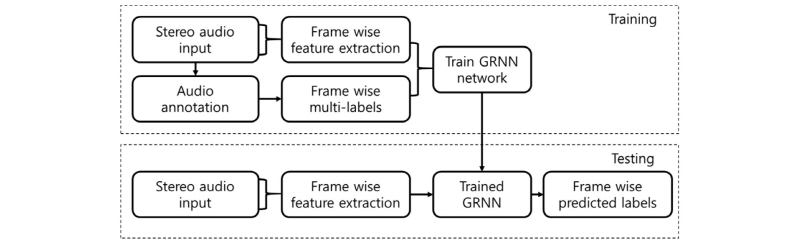

Fig. 1은 본 논문에서 제안하는 사운드 이벤트 검출 단계를 나타내는 블록도이다. 먼저 학습 단계에서는 스테레오 오디오 신호가 입력되면 해당되는 레이블을 적용한다. 그리고 신호 각각을 프레임 단위로 분할한 뒤 다채널 특징값을 추출하고 GRNN에 입력하여 학습을 진행한다. 학습 후 인식 과정에서는 스테레오 오디오 신호가 입력되면 신호를 프레임 단위로 분할한 뒤, 다채널 특징값을 추출한다. 추출된 특징값은 학습된 GRNN을 통과하여 해당 프레임에 대한 레이블별 확률이 적용되고, 최종적으로 모든 프레임의 확률값을 합하여 가장 높은 값을 가진 레이블의 사운드 이벤트로 분류한다.

2.1 스테레오 채널 기반의 오디오 특징 추출

본 논문에서 제안하는 사운드 이벤트 검출 시스템의 입력 특징값으로는 사람의 청각적인 특성을 고려하여 스테레오 오디오 신호로부터 Mel2, TDOA(Time Difference Of Arrival), Pitch 범위 특징값의 세 가지 특징값을 추출해 사용한다.

Mel 특징값은 로그 스케일의 멜 밴드 에너지 값을 추출한 것으로 사운드 이벤트 검출에 광범위하게 사용되어 왔으며 그 효과가 좋은 것으로 알려져 있다.[2,4,5] 제안하는 방식에서 Mel2 특징값은 로그 멜 밴드 에너지를 스테레오 채널로부터 추출한 특징값을 의미한다. 스테레오 채널의 사용은 인간의 청각 시스템이 오디오 신호의 공간적 위치 파악을 위해 두 귀 사이의 강도 차(Interarual Intensity Difference, IID)를 활용한다는 아이디어에서 비롯된 것이다. 따라서 스테레오 채널의 신호를 활용하면 신경망이 각각 채널의 차이점을 학습할 수 있기 때문에 IID와 유사한 정보를 얻는 방법을 배우게 된다. Mel2 특징값의 추출 단계는 다음과 같다. 입력된 스테레오 각 채널의 신호는 해밍 윈도우를 사용하여 40 ms 단위의 프레임으로 분할된다. 분할된 프레임에 50 %의 오버래핑을 적용한 뒤 각 프레임에 대한 로그 멜 밴드 에너지를 추출한다. 이때 멜 밴드는 전체 스펙트로그램에 걸쳐 40개를 사용한다.

실생활에서 발생하는 사운드 이벤트들은 각각 고유한 주파수 대역을 가지는데, 이러한 특성에 따라 귀 양측에 도달하는 시간의 지연 차이가 생기므로 사람은 여러 사운드 이벤트가 동시에 들리더라도 각각의 이벤트들을 구별하여 들을 수 있다. TDOA 특징값은 이러한 사운드 이벤트의 주파수 대역에 따른 시간차 특성에 기반하며, 추출 단계는 다음과 같다. 먼저 각 프레임으로 나눈 신호의 스펙트로그램을 5개의 멜 밴드로 나누고 각 밴드에 대한 TDOA를 계산한다. 같은 종류의 사운드의 경우에는 각 멜 밴드 대역에서 비슷한 TDOA 값을 가지고 반대로 다른 두 개의 중첩 된 사운드가 있는 경우에는 각 사운드에 대해 서로 다른 TDOA 값이 계산되므로 신경망은 이들을 구분하여 개별적인 소리 이벤트로 식별할 수 있다.

TDOA 특징값의 계산은 다음과 같이 나타낼 수 있다.

,

,

(1)

여기서 N은 주파수 대역의 수,  는 주파수 빈 인덱스,

는 주파수 빈 인덱스,  는 프레임 인덱스,

는 프레임 인덱스,  는 FFT(Fast Fourier Transform) 계수이다. 아래 첨자는 채널 번호를 의미하며

는 FFT(Fast Fourier Transform) 계수이다. 아래 첨자는 채널 번호를 의미하며  는 멜 필터 뱅크 중 b번째 밴드를 나타낸다.

는 멜 필터 뱅크 중 b번째 밴드를 나타낸다.  는 채널들 간의 샘플 지연 값이다.

는 채널들 간의 샘플 지연 값이다.

먼저 Eq. (1)을 통해  밴드에 대해 페이즈 기반의 가중치로 일반화된 상호 상관

밴드에 대해 페이즈 기반의 가중치로 일반화된 상호 상관  (generalized crosscorre-lation with phase-based weighting)을 추정한다.[6] TDOA는 멜 밴드와 시간 프레임의 상관 피크 크기 값의 위치로써 추출된다.

(generalized crosscorre-lation with phase-based weighting)을 추정한다.[6] TDOA는 멜 밴드와 시간 프레임의 상관 피크 크기 값의 위치로써 추출된다.

, (2)

, (2)

TDOA 값은 Eq. (2)에서 보는 것과 같이 구해진 상호상관 Rb에서 가장 큰 값을 나타내는  값이 두 채널 사이의 최종적인 도달 지연 시간이 된다. 학습 데이터베이스의 사운드 이벤트는 50 ms에서 수초까지 다양한 값을 갖기 때문에 TDOA에서 사용하는 윈도우의 길이는 120 ms, 240 ms, 480 ms 세 가지로 계산하며 hop 길이는 모두 20 ms로 일정하게 사용한다. 그리고 프레임의 각 서브 밴드에 대한 3개의 서로 다른 윈도우 길이로부터 계산한 TDOA의 중앙값을 계산하여 사용한다.

값이 두 채널 사이의 최종적인 도달 지연 시간이 된다. 학습 데이터베이스의 사운드 이벤트는 50 ms에서 수초까지 다양한 값을 갖기 때문에 TDOA에서 사용하는 윈도우의 길이는 120 ms, 240 ms, 480 ms 세 가지로 계산하며 hop 길이는 모두 20 ms로 일정하게 사용한다. 그리고 프레임의 각 서브 밴드에 대한 3개의 서로 다른 윈도우 길이로부터 계산한 TDOA의 중앙값을 계산하여 사용한다.

Pitch는 소리의 중요한 지각적 특징 중 하나이다. Uzkent et al.[7]은 다른 특징값과 pitch 특징값을 함께 사용하여 비음성 환경 사운드 검출에 대한 정확도가 향상됨을 보였다. 제안하는 방식에서 Pitch 특징값은 pitch 범위를 사용하여 두 가지 특징값을 추출하여 사용하며 과정은 다음과 같다.

, (3)

, (3)

, (4)

, (4)

, (5)

, (5)

, (6)

, (6)

는 pitch value를 나타내며, 다양한 방법으로 계산이 가능하지만 본 논문에서는 Uzkent et al.[7]의 방법을 사용했다. 스테레오 신호의 두 채널에 대해 평균값을 계산한 신호를 Short-time auto correlation 방법으로 첫 번째 피크와 두 번째 피크 사이의 주기를 계산한 뒤, 역수를 적용하여 pitch 값을 얻었다. 첫 번째 특징값인

는 pitch value를 나타내며, 다양한 방법으로 계산이 가능하지만 본 논문에서는 Uzkent et al.[7]의 방법을 사용했다. 스테레오 신호의 두 채널에 대해 평균값을 계산한 신호를 Short-time auto correlation 방법으로 첫 번째 피크와 두 번째 피크 사이의 주기를 계산한 뒤, 역수를 적용하여 pitch 값을 얻었다. 첫 번째 특징값인  는 pitch 범위 내 value의 최대값과 최소값의 비율로 계산된다. 두 번째 특징값인

는 pitch 범위 내 value의 최대값과 최소값의 비율로 계산된다. 두 번째 특징값인  는 pitch 범위 내의 평균값에 대한 표준편차의 비율로 계산된다. Eqs. (5)와 (6)은 평균값과 표준편차에 대산 계산을 나타낸다.

는 pitch 범위 내의 평균값에 대한 표준편차의 비율로 계산된다. Eqs. (5)와 (6)은 평균값과 표준편차에 대산 계산을 나타낸다.

2.2 게이트형 순환 신경망(GRNN)

본 논문에서 제안하는 다성 사운드 이벤트 검출에 적용한 GRNN은 순환 게이트 유닛 블록을 사용하는 순환 신경망이다. GRNN은 LSTM 신경망의 대체 방법으로 성능은 비슷하지만 구조가 더욱 간단하며 사용되는 매개 변수가 더 적으므로 실제 학습 시 시간이 적게 걸린다는 장점이 있다.

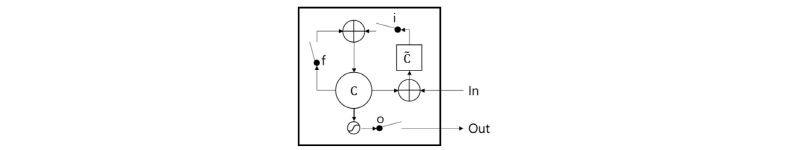

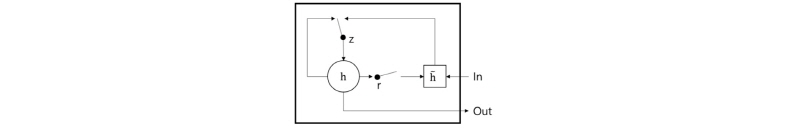

Fig. 2에서 보이는 것과 같이 기존의 LSTM 신경망은 입력 게이트 i, 망각 게이트 f, 출력게이트 o를 사용하는 반면 Fig. 3과 같이 GRNN은 리셋 게이트 r, 업데이트 게이트 z만 사용한다. LSTM 신경망에서 사용하는 입력 게이트, 망각 게이트의 역할을 GRNN의 업데이트 게이트로 유사하게 대체함으로써 내부 구조가 더 간단하고 연산 속도도 빠르다는 장점이 있다. 이 신경망 게이트의 스위치들은 정적 정보와 시간적 정보를 결합하여 신경망이 시간적인 정보를 학습하도록 한다. 특히 중요한 이벤트가 발생할 때마다 업데이트 게이트 z는 모델의 현재 상태를 재갱신하기로 결정한다. 리셋 게이트 r은 모델의 현재 상태를 삭제할 수 있으므로 신경망이 이전에 갖고 있던 정보를 잊어버릴 수 있다.

Fig. 3은 GRNN의 한 층에 대한 흐름도이다. 해당 그림은 업데이트 게이트 z와 리셋 게이트 r이 신경망 정보를 관리하는 방식을 나타낸다.  와

와  는 activation과 activation 후보를 나타낸다. 신경망 내부를 계산하는 식은 다음과 같다.

는 activation과 activation 후보를 나타낸다. 신경망 내부를 계산하는 식은 다음과 같다.

, (7)

, (7)

, (8)

, (8)

, (9)

, (9)

, (10)

, (10)

여기서  은 레이어 인덱스,

은 레이어 인덱스,  는 프레임 인덱스를 의미한다.

는 프레임 인덱스를 의미한다.  는 시그모이드 함수,

는 시그모이드 함수,  는 비선형 함수이다. Eq. (7)은 레이어

는 비선형 함수이다. Eq. (7)은 레이어  의 출력 상태

의 출력 상태  에서 시작한다. 신경망은 업데이트 상태

에서 시작한다. 신경망은 업데이트 상태  을 사용하여 이전 상태

을 사용하여 이전 상태  과 현재의 정보

과 현재의 정보  사이의 선형 보간을 계산한다. 업데이트 상태

사이의 선형 보간을 계산한다. 업데이트 상태  은 유닛이 활성화 또는 정보를 업데이트하는 양을 결정한다.

은 유닛이 활성화 또는 정보를 업데이트하는 양을 결정한다.  은 Eq. (8)에서 입력

은 Eq. (8)에서 입력  와 과거의 은닉 상태

와 과거의 은닉 상태  를 시그모이드 함수에 적용하여 계산된다. 식에서 W와 b는 각각 모델의 가중치와 바이어스 값을 의미한다. Eq. (9)에서 네트워크의 상태

를 시그모이드 함수에 적용하여 계산된다. 식에서 W와 b는 각각 모델의 가중치와 바이어스 값을 의미한다. Eq. (9)에서 네트워크의 상태  는 아핀 변환 된 입력과 이전의 은닉 상태

는 아핀 변환 된 입력과 이전의 은닉 상태  에 비선형 함수 g를 적용하여 계산한다. 여기에서는 추가적으로 리셋 상태

에 비선형 함수 g를 적용하여 계산한다. 여기에서는 추가적으로 리셋 상태  이 이전의 은닉 상태

이 이전의 은닉 상태  의 요소 단위 곱셈이 적용된다. Eq. (10)에서 리셋 상태

의 요소 단위 곱셈이 적용된다. Eq. (10)에서 리셋 상태  은 현재 입력 프레임

은 현재 입력 프레임  와 이전의 은닉상태

와 이전의 은닉상태  로부터 계산된다. 같은 방법으로 이 신경망 유닛을 여러 개의 레이어로 쌓아서 깊은 신경망을 만들 수 있다.

로부터 계산된다. 같은 방법으로 이 신경망 유닛을 여러 개의 레이어로 쌓아서 깊은 신경망을 만들 수 있다.

III. 실 험

3.1 실험 데이터

실험에서는 DCASE(Detection and Classification of Acoustic Scenes and Events) 2016에서 제공된 오디오 데이터베이스[8] 중 taks3인 Sound event detection in real life audio을 사용하였다. 해당 데이터는 Soundman 회사의 OKM II Klassik/studio A3 인이어 마이크와 Roland 회사의 Edirol R09 녹음기를 사용하여 스테레오로 녹음 되었고 샘플링 레이트는 44.1 kHz, 24비트의 깊이로 구성되어 있다. 데이터베이스는 천장소리, 식탁 식기류 소리, 씻는 소리 등 실내 집(home)에서 발생하는 소리와 새 소리, 자동차 지나가는 소리, 아이들 뛰어노는 소리와 같은 실외 주택가(residential area)에서 발생하는 소리들로 이루어져 있다. 집으로 분류된 소리 데이터는 10개의 녹음 파일과 11개의 클래스로 구성되어 있고, 실외 주택가의 데이터는 12개의 녹음 파일과 7개의 클래스로 구성 되어있다. 각각의 녹음파일은 3~5분의 길이로 구성 되어 있다.

3.2 측정 방식

본 논문에서는 데이터가 편중 되어 있는 것을 줄이기 위해 4-fold cross validation 방식으로 성능 측정 실험을 진행했으며, DCASE 2016에서 제공한 validation 설정에 따라 사용하였다.[8]

실험에 사용된 분류기는 GMM, LSTM, GRNN 세 가지를 사용하였으며 특징값은 MFCC+ +

+ , Mel energy, 3Sets(Mel2+TDOA+Pitch 범위 특징값)를 사용하여 측정하였다. 실험에서 LSTM은 3개의 히든 레이어를 사용했으며 각 레이어의 뉴런은 16개를 사용하였다. 그리고 GRNN은 3개의 히든 레이어를 사용했으며 각 레이어의 뉴런 수는 200개를 사용하였다. 입력 레이어 뉴런의 수는 사용한 오디오 신호의 길이에 따라 달라지고 출력 레이어 뉴런의 수는 클래스마다 한 개씩으로 사용하였다. 신경망의 학습에는 손실 함수로써 binary cross-entropy를 이용한 BPTT(Back Propagation Through Time)를 사용하였다.

, Mel energy, 3Sets(Mel2+TDOA+Pitch 범위 특징값)를 사용하여 측정하였다. 실험에서 LSTM은 3개의 히든 레이어를 사용했으며 각 레이어의 뉴런은 16개를 사용하였다. 그리고 GRNN은 3개의 히든 레이어를 사용했으며 각 레이어의 뉴런 수는 200개를 사용하였다. 입력 레이어 뉴런의 수는 사용한 오디오 신호의 길이에 따라 달라지고 출력 레이어 뉴런의 수는 클래스마다 한 개씩으로 사용하였다. 신경망의 학습에는 손실 함수로써 binary cross-entropy를 이용한 BPTT(Back Propagation Through Time)를 사용하였다.

실험의 측정 지표는 ER(Error Rate)와 F-score를 사용하였으며 1 s 단위의 세그먼트 기준으로 계산하였다.

ER과 F-score의 계산식은 다음과 같다.

, (11)

, (11)

여기서  는 substitutions,

는 substitutions,  는 deletions,

는 deletions,  는 insertions를 나타내고

는 insertions를 나타내고  는 전체 세그먼트 개수이다.

는 전체 세그먼트 개수이다.

, (12)

, (12)

여기서  는 정밀도(precision),

는 정밀도(precision),  은 재현율(recall)를 나타내고,

은 재현율(recall)를 나타내고,  는 true positive,

는 true positive,  는 false positive,

는 false positive,  은 false negative를 나타낸다.

은 false negative를 나타낸다.

3.3 실험 결과

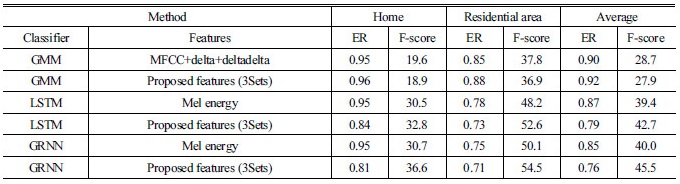

Table 1은 실험 결과를 나타낸다. Table 1에서 보이는 것과 같이 GMM 분류기에서 MFCC 특징값과 제안한 방식인 결합된 특징값을 사용하였을 경우를 비교하면 평균 ER 0.90, F-score 28.7이었던 수치가 각각 0.92, 27.9로 저하되었다. LSTM 신경망에서는 Mel energy 특징값을 사용한 경우와 제안한 방식의 특징값을 사용한 경우를 비교하면 ER 0.87, F-score 39.4이었던 수치가 각각 0.79, 42.7으로 향상된 것을 확인할 수 있다. 마찬가지로 GRNN에서도 Mel energy 특징값과 제안한 방식의 특징값을 사용한 경우 ER 0.85, F-score 40.0이었던 수치가 각각 0.76, 45.5로 향상되는 것을 확인할 수 있다.

실험 결과를 통해 기존의 단일 채널 기반의 특징값을 사용한 방식보다 청각적 특성을 고려한 스테레오 채널 기반의 결합된 특징값을 사용한 경우 성능이 향상되는 것을 확인할 수 있었다. 또한 분류 방식에서 GRNN을 사용하였을 경우 기존의 방식들보다 더욱 성능이 향상되는 것을 확인할 수 있었다.

IV. 결 론

본 논문에서는 다채널 오디오 특징값 및 GRNN을 사용한 다성 사운드 이벤트 검출 방식을 제안하였다. 제안한 방식은 기존의 사운드 이벤트 검출에서 널리 사용되던 단일 채널 기반의 특징값 대신 다채널 기반의 결합된 특징값을 사용하였으며, 분류기로서 시간적인 정보를 학습할 수 있는 순환 신경망의 변형 된 형태인 GRNN을 사용하였다. 실험 결과 제안한 방식의 성능이 기존의 분류 방식의 성능보다 뛰어남을 확인할 수 있었다.

향후 본 연구를 바탕으로 기존의 컨벌루션 신경망과 GRNN을 결합한 구조에 본 논문에서 사용한 결합된 특징값을 적용하여 사운드 이벤트 검출에 적용하는 방식에 대해 연구할 계획이다.