I. 서 론

II. 수동소나 표적신호

III. 신호분류 알고리즘

3.1 게이트 순환 유닛

3.2 게이트 순환 유닛을 이용한 신호분류

IV. 실험 및 결과

4.1 데이터 구성

4.2 분류 모델 구현

4.3 분류 결과

V. 결 론

I. 서 론

항해중인 선박 및 항만의 안전을 위해 수동소나 기반의 감시체계가 운용되고 있다. 수중 상황 인지를 위해 수동소나의 주 표적인 선박 신호의 분류가 우선적으로 요구된다. 선박 신호는 기계 장치에 의한 기계소음과 프로펠러에 의한 공동소음을 동반한다.[1,2] 기존 연구에서는 기계소음과 공동소음 분석을 위해 LOw Frequency Analysis and Recording(LOFAR)와 DEMOdulation of Noise(DEMON) 처리를 수행하고 협대역의 주파수선을 추적하여 선박신호를 식별한다.[3,4] 최근에는 영상처리 분야에서 주로 사용되는 심층 학습 알고리즘을 사용하여 괄목할만한 성과를 도출하였다.[5,6,7,8,9,10,11] 심층 학습을 통한 수동소나 신호의 분류에는 단시간 푸리에 변환으로 생성된 시간-주파수 영역의 특징이 주로 사용되며, Mel Frequency Cepstral Coefficients(MFCC), Mel Filter Bank(MFB) 에너지 등의 특징이 사용되기도 한다. 수동소나 신호에서 추출된 시간-주파수 영역 특징은 영상화되어 합성곱 신경망(Convolutional Neural Network, CNN)을 기반으로 분류된다. 합성곱 신경망은 영상화된 특징에서 시간-주파수 영역의 상관관계를 학습하지만, 순차적으로 입력되는 시계열 데이터의 특성을 고려하지 않는다.

순환 신경망(Recurrent Neural Network, RNN)은 시계열 데이터의 특징을 학습할 수 있는 대표적인 심층 학습 모델이다.[12] 특히 게이트 순환 유닛(Gated Recurrent Unit, GRU)은 기존 순환 신경망 모델들의 성능을 유지하면서 구조를 단순화하여 주목받고 있다.[13] 이러한 이유로 게이트 순환 유닛을 이용한 네트워크가 시계열 데이터 처리를 위해 주로 사용된다.[14,15] 일반적인 게이트 순환 유닛 네트워크는 인접한 시퀀스 데이터 간 상관관계를 학습하므로 전역적 시계열 특징 추출에 한계를 갖는다. 이러한 문제를 개선하고자 잔차 연결된 게이트 순환 유닛 네트워크(skip connected GRU network)가 제안되었다.[16] 잔차 연결된 게이트 순환 유닛 네트워크는 게이트 순환 유닛 간의 잔차 연결을 추가하여 지역 및 전역적 시계열 특징을 효율적으로 학습한다. 하지만 지역 및 전역적 시계열 특징 정보를 목적에 따라 가중할 수 없어서 데이터 특성에 따른 복잡한 설계가 요구된다.

본 논문에서는 지역 및 전역적 시계열 특징을 학습하는 게이트 순환 유닛 기반의 신호분류 알고리즘을 제안한다. 제안하는 알고리즘은 게이트 순환 유닛을 이용한 다층 네트워크를 구성하고 점진적으로 확장된 연결(dilated connection)을 통해 지역 및 전역적 시계열 특징을 추출한다. 이후 어텐션 메커니즘(attention mechanism)을 학습하여 시계열 특징들을 가중하고 신호를 분류한다. 수동소나 신호 분류에서는 단시간 푸리에 변환으로 시간-주파수 영역 특징을 생성하고 시간에 따른 특징벡터를 순차적으로 입력한다. 본 논문에서는 공개된 수중 음향 데이터를 이용한 실험을 통해 제안된 분류 알고리즘의 성능을 기존 방법들과 비교하여 평가한다.

II. 수동소나 표적신호

수동소나의 주 표적인 선박신호는 엔진 및 기타 장비에 의한 기계소음, 프로펠러의 공동현상에 의한 공동소음, 유체와의 마찰에 의한 유체소음을 포함한다.[1,2] 선박신호의 주된 특성인 기계소음은 Eq. (1)과 같이 혼재된 고조파 협대역 신호로 정의된다.

여기서 은 기계소음원의 수, 은 기계소음원의 고조파 개수를 의미한다. 또한 는 시간에 따른 신호 세기, 는 신호의 초기 위상을 나타내며, 는 번째 신호의 기본 주파수를 의미한다. 기계소음 중에서 선박 엔진음의 는 엔진의 분당 회전수 에 따라 0.16으로 결정된다. 이러한 선박의 기계소음은 일정한 협대역 주파수에서 수초 내 세기가 변동되는 특성을 갖는다.

해수면에 의해 생성된 가상음원의 간섭에 의한 로이드 거울 효과(Lloyd’s mirror effect)는 시간-주파수 영역에서 U자 패턴을 형상화한다.[17,18] 로이드 거울 효과로 인한 간섭 패턴은 Eq. (2)와 같이 발생한다.

여기서 는 음원의 파수, 는 음원의 수심, 는 하이드로폰의 수심, 는 시간에 따른 음원과 하이드로폰 간의 수평거리를 의미한다. 이러한 로이드 거울 효과는 수십 초 간 주파수 변이를 유발한다.

III. 신호분류 알고리즘

3.1 게이트 순환 유닛

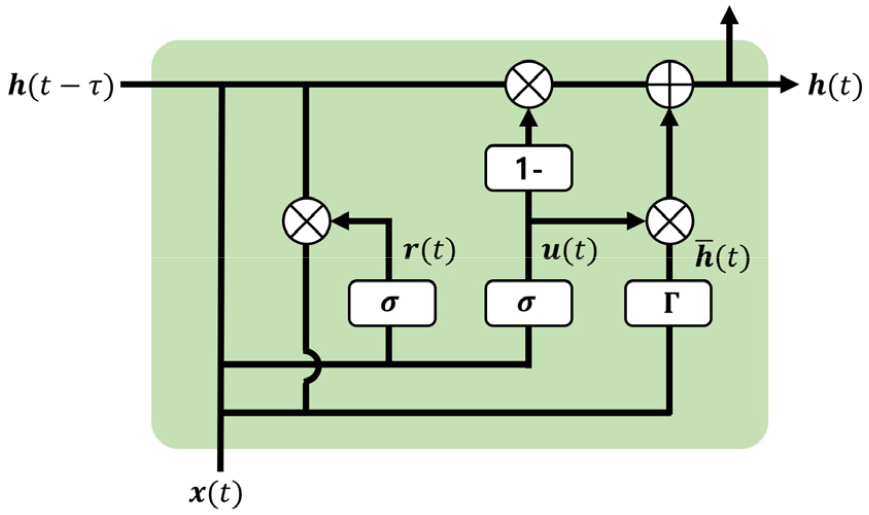

게이트 순환 유닛은 순환 신경망의 일종으로 장단기 메모리(Long Short Term Memory, LSTM)를 경량화한 모델이다.[13] 본 논문에서는 시간에 따른 특징벡터의 처리에 기반하여 게이트 순환 유닛을 소개한다. 게이트 순환 유닛은 Fig. 1과 같이 초기화 게이트, 갱신 게이트 후보군 계산, 은닉층 계산 과정을 수행한다. 초기화 게이트는 시그모이드 함수 를 이용하여 과거 정보를 초기화하며, 𝜏시간 이전 시퀀스의 은닉층 출력 과 현재 시퀀스의 정보 에 가중치 과 을 적용하여 Eq. (3)과 같이 수행된다.

일반적으로 𝜏는 현재 시점에서 직전 시퀀스의 시간차로 정의된다. 갱신 게이트는 직전 시퀀스와 현재 시퀀스의 가중 정도 를 Eq. (4)와 같이 결정한다.

여기서 와 는 과 에 대한 갱신 게이트 내 가중치를 의미한다. 후보군 계산은 를 에 곱하고 가중치 를 적용하여 Eq. (5)와 같이 수행된다.

여기서 는 탄젠트 하이퍼볼릭 함수, 요소 별 곱셈 연산을 의미한다. 끝으로 와 를 결합하여 현재 시퀀스의 은닉층 출력 을 Eq. (6)과 같이 계산한다.

3.2 게이트 순환 유닛을 이용한 신호분류

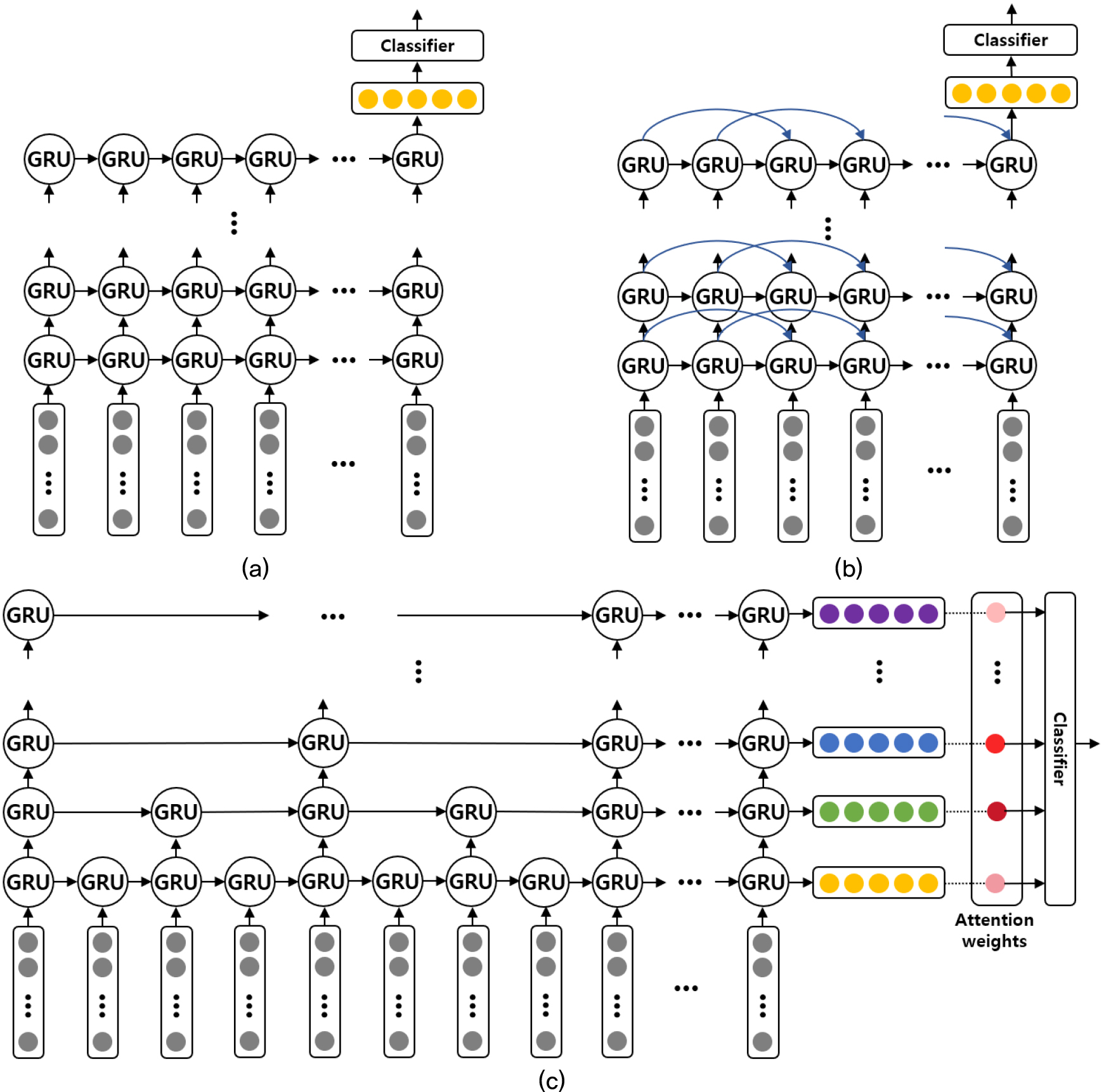

본 절에서는 게이트 순환 유닛을 이용한 수동소나의 신호분류 방법들을 소개하고, 기존 방법들의 한계를 개선하고자 어텐션 기반의 신호분류 알고리즘을 제안한다. Fig. 2는 게이트 순환 유닛을 이용한 신호 분류 방법들을 도시화한다. 게이트 순환 유닛은 시계열 특징의 수만큼 정렬되어 순차적으로 특징을 입력받는다.[13] 이러한 게이트 순환 유닛 네트워크를 Fig. 2(a)와 같이 적층하여 심층 학습을 수행하고, 최종 층에서 종료 시점의 은닉층 출력을 사용하여 신호를 분류할 수 있다. 적층된 게이트 순환 유닛 네트워크(stacked GRU network)는 인접 시간의 특징 간 상관관계를 학습하므로 전역적 시계열 특징 추출에 한계를 갖는다. 이러한 한계를 극복하고자 Fig. 2(b)와 같이 잔차 연결된 게이트 순환 유닛 네트워크가 사용될 수 있다. 잔차 연결된 게이트 순환 유닛 네트워크는 게이트 순환 유닛 간의 잔차 연결을 추가하여 지역 및 전역적 시계열 특징을 효율적으로 학습한다.[16] 현재 시점의 게이트 순환 유닛은 과 이전 시점의 은닉층 출력 을 Eq. (7)과 같이 병합하여 현재 시점의 은닉 상태 로 입력받는다.

따라서 Eqs. (3), (4), (5), (6)의 을 로 변경하여 특징벡터를 처리한다. 잔차 연결된 게이트 순환 유닛 네트워크는 지역 및 전역적 시계열 특징 정보를 목적에 따라 가중할 수 없어서 데이터 특성에 따른 복잡한 설계가 요구된다.

기존의 게이트 순환 유닛을 이용한 분류 방법들의 한계를 개선하고자 Fig. 2(c)와 같이 어텐션 기반 확장된 게이트 순환 유닛 네트워크(attention dilated GRU network)를 제안한다. 첫 번째 층에서는 시계열 입력 특징의 수와 동일하게 게이트 순환 유닛을 배치하고 순차적으로 특징을 입력받아 처리한다. 이후 층이 적층됨에 따라 일정 시간 간격을 두고 게이트 순환 유닛을 배치하여 점진적으로 확장된 연결을 구현한다. 제안하는 네트워크의 게이트 순환 유닛은 Eqs. (8), (9), (10), (11)과 같이 동작한다.

여기서 은 개 층으로 적층된 네트워크의 층 순번을 의미하며, 𝜏는 Eq. (12)와 같이 에 따라 결정된다.

여기서 는 현재 시점과 직전 시퀀스 간 시간 차이이며, 는 두 번째 층부터 확장 연결을 위한 기준 시간 간격으로 의 조건을 만족한다. 따라서 제안하는 네트워크는 다양한 스케일의 시계열 특징을 추출하고자, 두 번째 층부터 층수에 비례하여 가장 작은 정수배인 2배수로 확장된 연결을 갖는다. 제안하는 네트워크는 각 층에서 종료 시점 유닛의 은닉층 출력 을 특징벡터로 추출한다. 이후 어텐션 메커니즘에 기반하여 학습된 가중치 을 Eq. (13)과 같이 에 적용하고 통합된 특징벡터 를 획득한다.

이후 분류기는 를 입력받아 신호의 분류 결과를 출력한다. 제안하는 네트워크는 Eq. (14)와 같이 분류기의 예측 결과 과 실제 값 를 이용한 교차 엔트로피 손실을 통해 종단간 학습(end to end learning)을 수행한다.

제안하는 네트워크는 서로 다른 스케일의 시계열 특징들에 어텐션 기반 가중치를 적용하여 분류를 위한 효율적인 학습을 수행한다.

IV. 실험 및 결과

4.1 데이터 구성

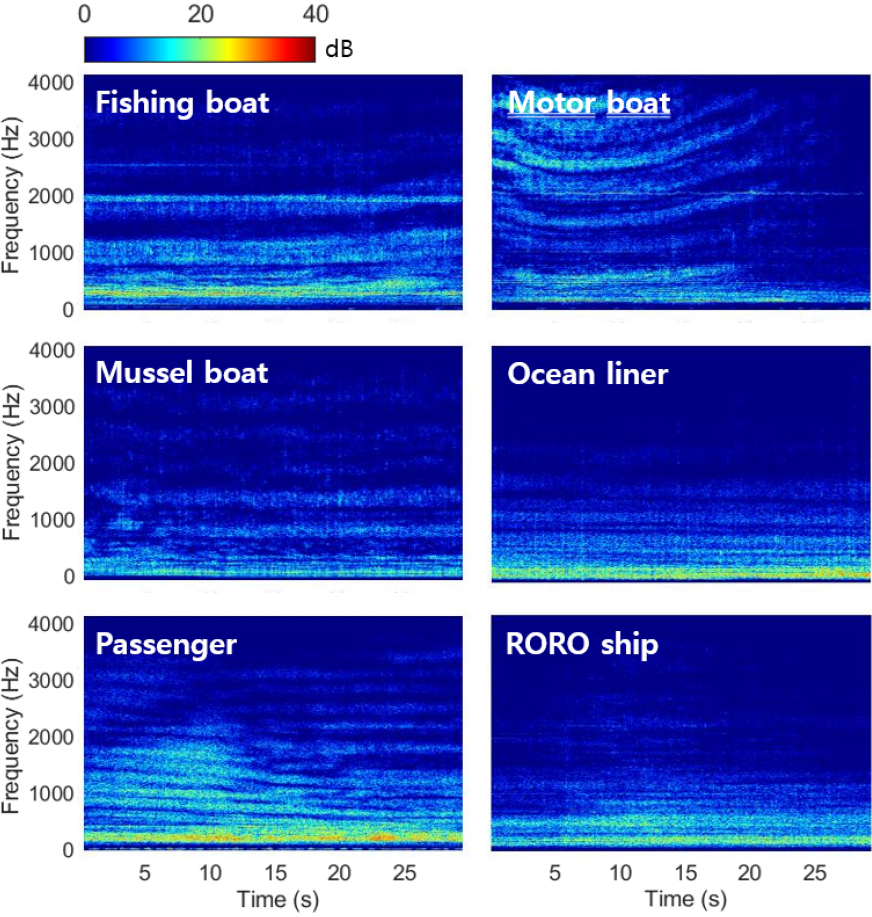

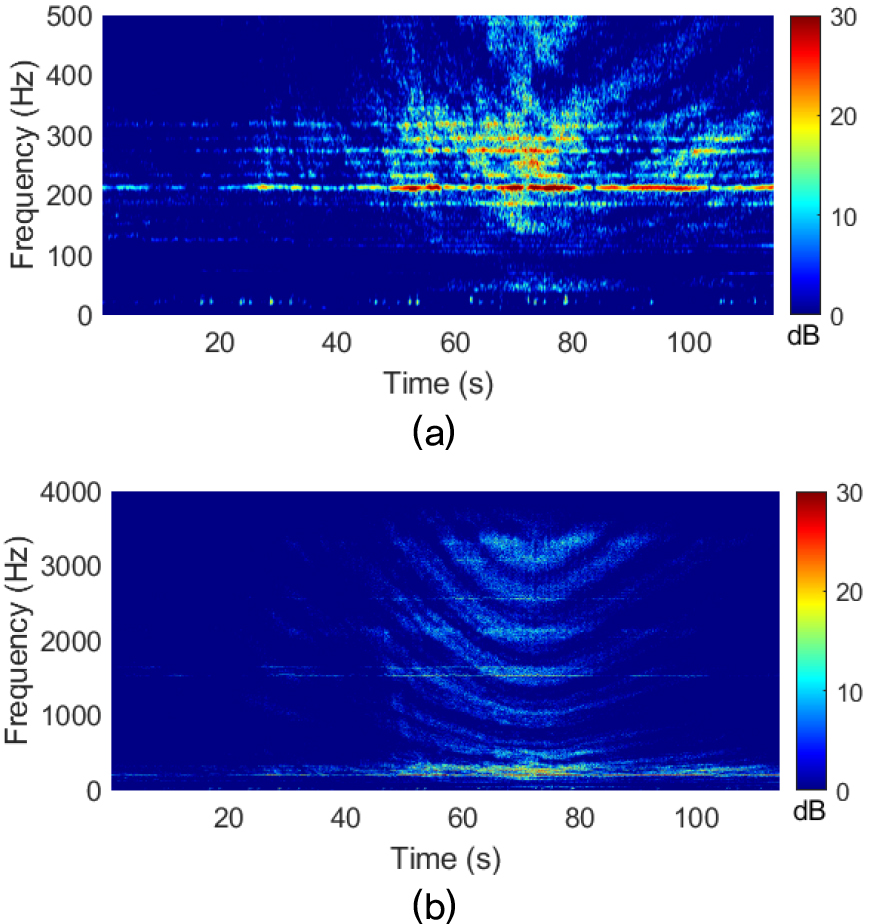

공개된 수중 음향 데이터인 ShipEar database[19]의 다양한 선종에 따른 음향 신호를 이용하여 제안된 알고리즘의 성능을 평가한다. 본 논문에서는 ShipEar database의 11종 선박신호 중에서 학습 데이터를 충분히 확보할 수 있는 어선, 모터보트 등 6종의 선박신호를 사용한다. Fig. 3은 실험에 사용되는 선박 신호들의 대표적인 스펙트로그램을 보여준다. 앞서 2장에서 기술한 바와 같이 선박신호는 기계적 동작에 의한 고조파 협대역 신호로 나타나며, 로이드 거울 효과에 의한 주파수 변이를 수반한다. 고조파 협대역 신호는 시간에 따라 일정한 고조파 주파수에서 수초 내 세기의 변화를 갖는다. 또한 로이드 거울 효과에 의한 주파수 변이는 수십 초 동안 지속된다. Fig. 4는 모터보트 신호에서 관찰되는 고조파 협대역 성분과 로이드 거울 효과에 의한 주파수 변이 현상을 보여준다.

선박신호 분류 모델의 학습 및 평가에 사용되는 데이터는 90 % 오버랩하여 30 s 길이로 생성되었다. 각 선종 별 학습 데이터는 무작위로 80개가 선택되고, 평가 데이터는 잔여 데이터 중 무작위로 20개가 선택된다. Table 1은 학습 및 평가에 사용되는 선박신호의 데이터 구성을 보여준다. 분류 모델의 학습에는 30 s 길이의 6종 선박신호가 총 480개, 모델의 평가에는 120개가 사용된다. 실험에 사용되는 30 s 길이 데이터는 8789 Hz 표본화율을 가지며, 단시간 푸리에 변환을 통해 스펙트로그램으로 변환된다. 스펙트로그램은 0.5 s 단위 시간 윈도우에 88.5 % 오버랩이 적용된 총 512번의 단시간 푸리에 변환에 의해 생성된다. 변환 과정에서 단시간 푸리에 변환을 통해 표현되는 주파수 간격은 8.5 Hz로 설정된다. 이와 같이 생성된 512 × 512 크기의 스펙트로그램은 최소-최대 스케일링 정규화 과정을 거쳐 분류 모델에 입력된다. Table 2는 데이터 처리를 위한 설정들을 보여준다.

Table 1.

Underwater acoustic dataset for experiments.

| Data type | Train data | Test data |

| Fishing boat | 80 | 20 |

| Motor boat | 80 | 20 |

| Mussel boat | 80 | 20 |

| Ocean liner | 80 | 20 |

| Passenger | 80 | 20 |

| Roll-On/Roll-Off RORO ship | 80 | 20 |

| Total | 480 | 120 |

Table 2.

Parameters and settings for data processing.

| Audio data | |

| Sampling rate | 8789 Hz |

| Audio length | 30 s |

| Spectrogram | |

| Window length | 0.5 s |

| Overlap | 88.5 % |

| Frequency interval | 8.5 Hz |

| Normalization method | Min-max scaling |

| Input size | 512 × 512 |

4.2 분류 모델 구현

본 절에서는 선박신호 분류를 위해 합성곱 신경망, 적층된 게이트 순환 유닛 네트워크, 잔차 연결된 게이트 순환 유닛 네트워크, 어텐션 기반 확장된 게이트 순환 유닛 네트워크를 구현하고 성능을 비교한다. 합성곱 신경망은 64, 32, 16, 16, 16개의 합성곱 필터, 3, 3, 2, 2, 2의 커널 크기로 구성되는 5층의 은닉 층을 보유한다. 5번째 층을 제외한 은닉 층에서는 (3, 3), (3, 3), (2, 2), (2, 2)의 최대값 추출을 수행한다. 각각의 은닉 층은 합성곱 연산 이후에 배치 정규화와 Rectified Linear Unit(ReLU) 활성화 함수에 대한 수행을 포함한다. 5번째 은닉 층에서는 과적합 방지를 위해 0.3의 드롭아웃을 수행한다. 합성곱 층에 의해 추출된 특징은 2304개의 입력 노드와 6개의 출력 노드를 갖는 완전 연결층에 입력되고 소프트맥스(Softmax) 연산을 통해 분류 결과를 출력한다. Table A1은 구현된 합성곱 신경망의 구조를 보여준다.

적층된 게이트 순환 유닛 네트워크는 5층의 게이트 순환 유닛 네트워크와 분류를 위한 완전 연결층으로 구성된다. 각 층의 네트워크는 512개의 게이트 순환 유닛으로 구성되며, 각 유닛은 512, 256, 128, 64 길이의 벡터를 출력한다. 5번째 층의 종료 시점 유닛의 벡터를 64개 입력 노드와 6개 출력 노드를 갖는 완전 연결층에 입력하고 소프트맥스 연산을 통해 분류 결과를 출력한다. Table A2는 적층된 게이트 순환 유닛 네트워크 구조를 보여준다. Table A2의 네트워크는 현 시점에서 바로 이전 시점의 은닉층 출력을 입력받는다. 따라서 Table 2와 같이 생성된 스펙트로그램을 시퀀스로 입력받는 경우 𝜏가 0.05 s인 시계열 특징 정보를 학습한다. 이와 유사하게 본 논문에서는 𝜏가 4 s인 특징을 입력받아 처리할 수 있는 네트워크를 Table A3와 같이 구현한다.

본 논문에서는 5층의 잔차 연결된 게이트 순환 유닛 네트워크를 구현한다. 잔차 연결된 게이트 순환 유닛 네트워크는 𝜏는 0.05 s인 직전 시퀀스 연결을 가지며, 2에서 5번째 층에서 가 각각 0.5 s, 1 s, 2 s, 4 s인 잔차 연결을 수행한다. Table A4는 잔차 연결된 게이트 순환 유닛 네트워크 구조를 보여준다.

다른 게이트 순환 유닛 네트워크들과 동일하게 5층의 어텐션 기반 확장된 게이트 순환 유닛 네트워크를 구현한다. 모든 층의 게이트 순환 유닛들은 256 길이의 벡터를 출력하며, 와 는 각각 0.05 s와 0.5 s로 설정된다. 따라서 2에서 5번째 층에서 0.5 s, 1 s, 2 s, 4 s 간격의 2배수되는 점진적 확장 연결을 수행한다. 잔차 연결과 다르게 확장 연결은 인접한 유닛과의 연결을 완전히 차단한다. 또한 어텐션 기반 확장된 게이트 순환 유닛 네트워크는 각 층의 종료 시점 유닛의 벡터들을 출력하고 어텐션 메커니즘에 의한 가중치를 적용한다. Table 3는 어텐션 기반 게이트 순환 유닛 네트워크 구조를 보여준다. 본 논문에서 구현하는 모든 분류 모델들은 32 배치 크기 설정과 0.01 학습률의 Adam optimizer를 사용하여 학습되며, 모든 모델들의 손실 값이 수렴할 수 있도록 에폭(Epoch)은 500으로 설정된다. 여기서 배치 크기는 ‘NVIDIA GeForce GTX 1070’ Graphical Processing Unit(GPU)의 구동이 가능도록 설정되고, 학습률은 학습 과정에서 손실 값이 수렴하도록 결정된다.

Table 3.

Attention dilated GRU network architecture.

4.3 분류 결과

4.2절에서 구현된 분류 모델들의 성능을 비교한다. 또한 확장된 게이트 순환 유닛 네트워크에 어텐션 메커니즘의 적용 유무에 따른 성능을 함께 비교한다. 어텐션 메커니즘이 적용되지 않은 경우는 Eq. (13)에서 은 모두 1로 결정됨을 의미한다. 본 논문에서는 이러한 네트워크를 균일 확장된 게이트 순환 유닛 네트워크(Uniform dilated GRU network)로 정의한다.

Table 4는 분류 모델에 따른 선종 별 10회 평균된 분류 정확도와 학습 소요 시간을 보여준다. Table 4에서 적층된 게이트 순환 유닛 네트워크의 와 는 각각 Tables A2와 A3와 같이 구현된 네트워크의 성능을 의미한다. Table 4의 결과에서 인 적층된 게이트 순환 유닛 네트워크는 영상의 상관관계를 학습하는 합성곱 신경망과 비교하여 2.00 % 우수한 평균 분류 정확도를 나타낸다. 반면에 인 적층된 게이트 순환 유닛 네트워크는 이산적인 시계열 특징 입력으로 인해 76.16 %의 낮은 평균 정확도를 보인다. 잔차 연결된 게이트 순환 유닛 네트워크는 유닛 간 다양한 시간 간격을 학습하여 92.33 %의 우수한 평균 분류 정확도를 획득하며, 이러한 결과는 합성곱 네트워크 및 적층된 게이트 순환 유닛 네트워크보다 우수한 성능을 나타낸다.

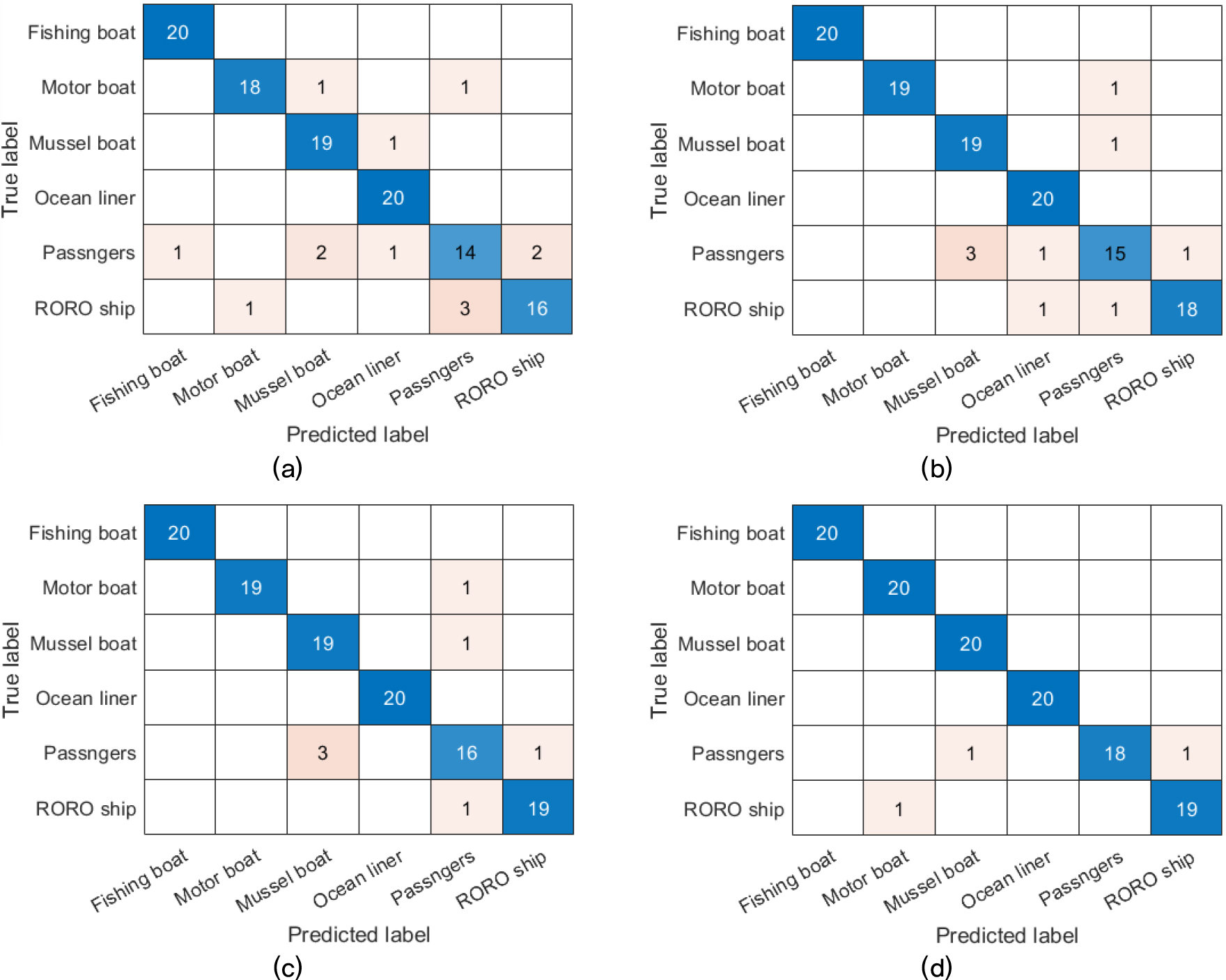

Table 4.

Accuracy in % and training time for classification models evaluated with ShipEar dataset.

제안하는 어텐션 기반 확장된 게이트 순환 유닛 네트워크는 96.50 %의 가장 우수한 평균 분류 정확도를 보여준다. 이러한 결과는 균일 확장된 게이트 순환 유닛 네트워크과 비교하여 2.84 % 향상된 성능을 나타낸다. 따라서 제안하는 네트워크는 매 층별로 서로 다른 시간 간격에 의한 특징벡터들을 추출하고 어텐션 메커니즘을 통해 효율적으로 통합하여 우수한 분류 성능을 획득한다. 추가적으로 제안하는 네트워크는 층수에 비례한 게이트 순환 유닛의 감소로 7.40 min의 적은 학습 시간을 소요한다. 이러한 네트워크의 학습 파라미터 감소는 적은 데이터의 학습에 효율적일 수 있다. Fig. 5는 분류 네트워크 별 대표적인 혼동 행렬을 보여준다. Table 4과 Fig. 5에서 게이트 순환 유닛을 이용한 네트워크들은 합성곱 신경망과 비교하여 여객선과 로로선에 대한 분류 성능을 개선한다. 특히, 제안하는 어텐션 기반 게이트 순환 유닛 네트워크는 여객선과 로로선에 대한 분류 성능을 크게 향상시킨다.

2 kHz 이하의 저주파 대역 스펙트로그램 특징을 사용하여 로이드 거울 효과가 최소화된 상황의 모델 별 분류 성능 및 학습 소요 시간을 Table 5에서 보여준다. Table 5의 선종 별 분류 정확도는 10회 평균된 값으로 기술된다. 평가에 사용된 저주파 스펙트로그램은 3.9 Hz의 주파수 간격을 제외하고 Table 2와 동일하게 생성되며, 구현된 모델들은 512 × 512 크기의 스펙트로그램에 대한 분류를 수행한다. 로이드 거울 효과에 의한 전역적 시계열 특징이 감소됨에 따라 모든 모델들이 Table 4의 결과와 비교하여 저하된 평균 분류 정확도를 보여준다. 특히 Table 4에서 상대적으로 낮은 분류 정확도를 보이는 여객선과 로로선에 대한 분류 성능이 Table 5에서 더욱 크게 저하된다. Tables 4와 5에서 제안하는 어텐션 기반 확장된 게이트 순환 유닛 네트워크의 평균 분류 정확도가 4.5 % 저하되며, 균일 확장된 게이트 순환 유닛 네트워크와 비교하여 단지 1.16 % 높은 평균 정확도를 갖는다. Table 5에서 스펙트로그램의 전역적 시계열 특징이 감소됨에도 불구하고 제안하는 네트워크는 다중 스케일의 시계열 특징들을 효율적으로 통합하여 가장 우수한 92.00 %의 평균 분류 정확도를 보여준다. 추가적으로 학습 소요 시간은 입력되는 스펙트로그램의 크기와 모델 별 파라미터의 변화가 없으므로 크게 변동되지 않는다.

Table 5.

Accuracy in % for classification models evaluated using low frequency features.

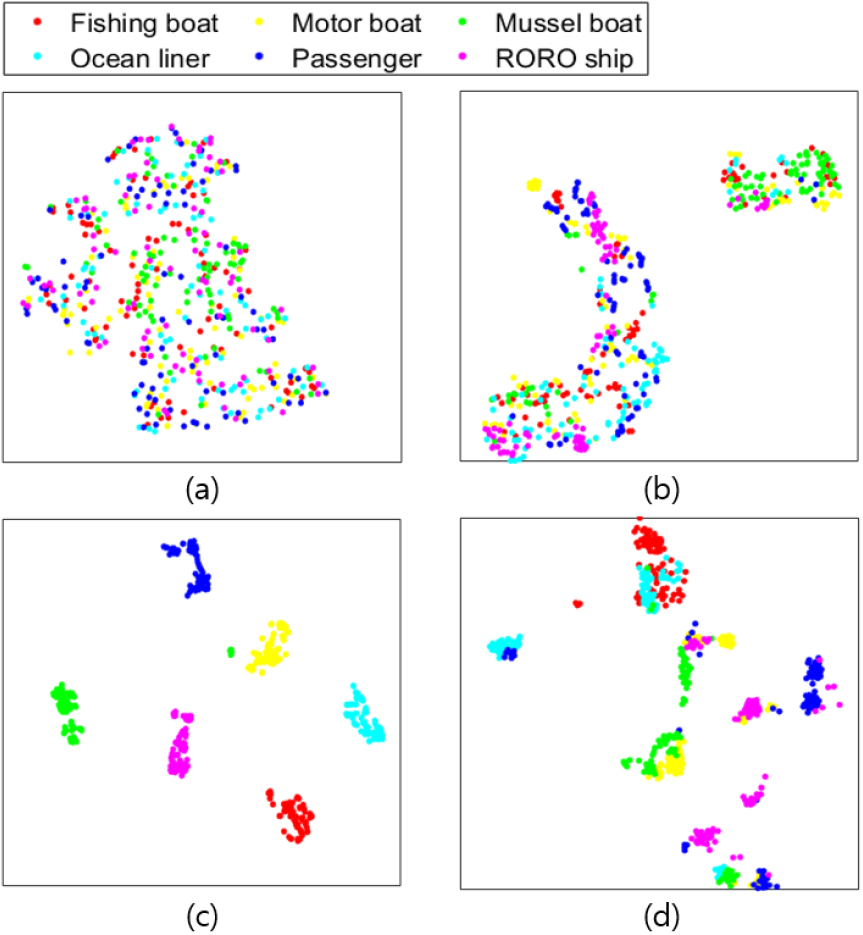

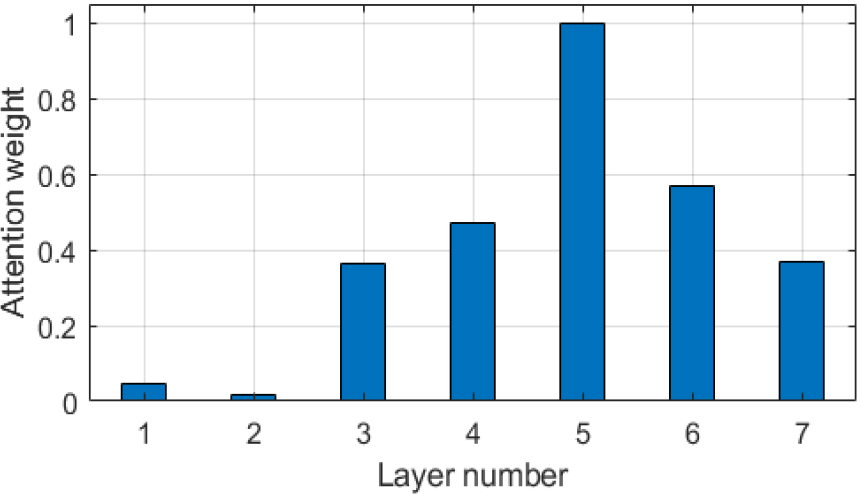

Table 3의 어텐션 기반 게이트 순환 유닛 네트워크를 7층으로 확장하고 시계열 특징의 스케일에 따른 변별력을 평가한다. 여기서 확장된 6, 7번째 네트워크는 8 s와 16 s의 확장된 연결을 갖는다. Figs. 6과 7은 층 별로 추출된 특징벡터의 t-SNE plot과 학습된 어텐션 가중치를 보여준다. Figs. 6과 7에서 특징벡터의 변별력에 따라 어텐션 가중치가 효율적으로 학습됨을 확인할 수 있다. 특히 5번째 층에서 추출된 특징벡터가 우수한 변별력을 보유함과 동시에 높은 어텐션 가중치로 분류에 사용된다. Fig. 6(c)에서 5번째 층의 특징벡터는 홍합선(Mussel boat)의 분류에서 상대적으로 저하된 변별력을 갖는다. 이를 개선하고자 Fig. 6(b)와 같이 홍합선에 대해 우수한 변별력을 갖는 3번째 층의 특징벡터에 상대적으로 높은 어텐션 가중치가 설정된다.

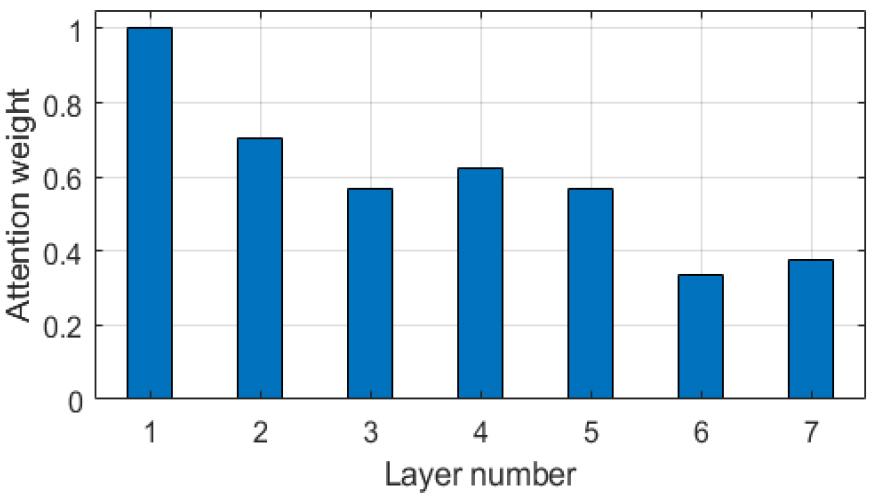

Fig. 8은 2 kHz 이하의 저주파 대역 스펙트로그램을 사용하여 학습된 어텐션 가중치를 보여준다. 저주파 대역 신호는 수초 내 세기가 변동되는 특징을 가지며, 어텐션 가중치는 0.05 s 간격의 상관관계를 학습하는 첫 번째 층의 특징벡터에 가장 높게 학습된다. 이로써 제안하는 네트워크의 어텐션 메커니즘이 다중 스케일의 시계열 특징벡터들을 변별력에 따라 효율적으로 가중하는 것을 검증한다.

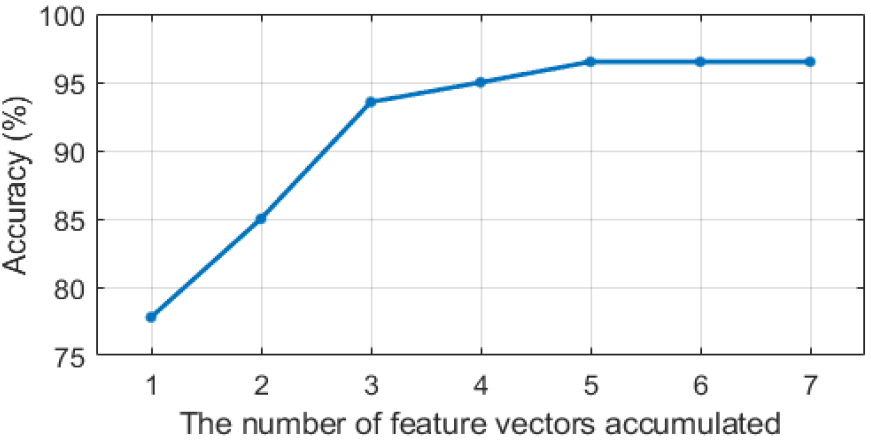

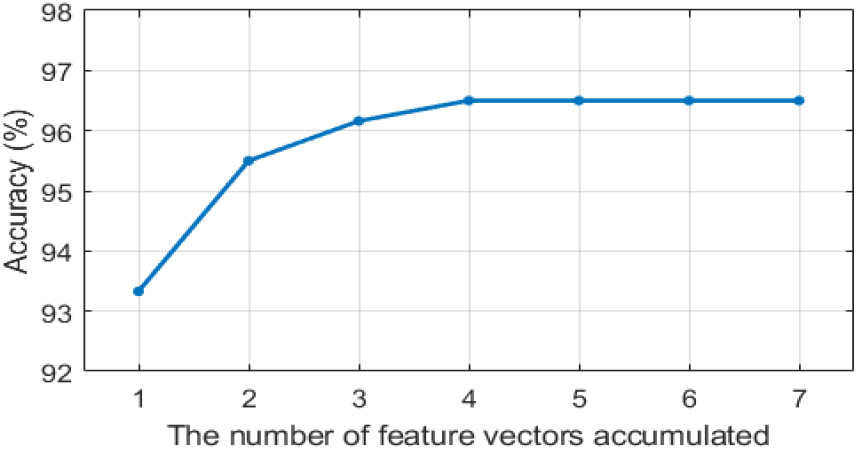

1에서 7층까지의 어텐션 가중치가 적용된 특징벡터를 순차적으로 누적 합하여 Fig. 9와 같이 분류 성능을 평가한다. Fig. 9의 분류 정확도는 10회 평균하여 계산된다. Fig. 9에서 특징벡터가 누적됨에 따라 분류 성능이 향상되고 5번째부터 96.50 %로 수렴되는 것을 확인할 수 있다. Fig. 10은 어텐션 가중치가 높은 순서로 특징벡터들을 누적 합하여 평가된 분류 성능을 보여준다. 따라서 Fig. 7에서 결정된 어텐션 가중치에 따라 5, 6, 4, 7, 3, 1, 2층의 순서로 누적 합을 수행하고, 특징벡터의 누적 합에 따른 분류 정확도는 10회 평균하여 도출된다. Fig. 10에서 5번째 단일 특징벡터를 사용할 경우 93.33 %의 평균 분류 정확도를 가지며, 특징벡터를 누적함에 따라 96.50 %의 향상된 성능을 얻을 수 있다. 따라서 제안하는 네트워크는 어텐션 메커니즘을 이용하여 변별력이 낮은 특징벡터의 사용으로 인한 성능 저하를 방지한다.

V. 결 론

수동소나의 표적신호는 기계소음에 의한 협대역 고조파 특성과 로이드 거울 효과에 의한 시간에 따른 주파수 변이 특성을 갖는다. 협대역 고조파 신호는 단시간 내 세기의 변화를 가지며, 로이드 거울 효과는 장시간에 걸친 주파수 변이를 야기한다. 본 논문에서는 수동소나 신호분류를 위해 다양한 스케일의 시계열 특징을 학습하는 어텐션 기반 게이트 순환 유닛 네트워크를 제안하였다. 제안하는 분류 모델은 효율적인 시계열 특징의 학습이 가능한 게이트 순환 유닛을 사용하여 다층 구조의 네트워크를 구성하고, 층에 따라 점진적으로 확장된 연결을 통해 다중 스케일의 시계열 특징벡터들을 추출한다. 추출된 특징벡터들은 어텐션 메커니즘 학습을 통해 가중되어 신호분류에 사용된다. 수중 음향 데이터를 이용한 실험에서 제안된 모델은 기존 모델들과 비교하여 96.50 %의 가장 우수한 평균 분류 정확도를 보였다.

제안된 분류 알고리즘은 수동소나를 이용한 감시체계에 응용되어 군사적 목적에 크게 기여할 수 있을 것으로 기대된다. 향후 다양한 수중 음향 환경과 표적 신호에 대한 알고리즘의 실험적 검증이 수행되어야 한다.

부 록(Appendix)