I. 서 론

II. 연구 및 실험 방법

2.1 고관절 이형성증 X-ray 및 초음파 영상 데이터셋 준비

2.2 영상 전처리

2.3 특징점 검출을 위한 딥러닝 모델 및 훈련

2.4 데이터 증강(Data augmentation)

2.5 훈련 성능 분석 방법

III. 실험 및 결과

3.1 특징점 검출 딥러닝 모델 비교 결과

3.2 고관절 X-ray 및 초음파 영상에서의 특징점 검출 결과

3.3 검출된 특징점을 이용한 고관절 이형성증에 관한 각도 측정

IV. 결론 및 향후 계획

I. 서 론

고관절은 골 반쪽 관절면의 비구와 하지의 대퇴골두가 연결되어 이루어지는 관절로 골반의 압력을 지지하며, 몸을 세우거나 달릴 때 전체적인 하지의 움직임을 이루어지도록 만드는 주요 관절이다. 그러나 고관절의 이상 변형이 일어나면, 비구와 대퇴골두 간의 접촉 면적이 줄어들게 되어 결과적으로 관절의 압력이 증가하게 된다. 이는 관절 연골의 퇴행성 변화를 촉진시키는 주요 원인이 된다. 이러한 이상 변형은 원활한 관절 운동을 방해하거나 관절면의 불일치를 유발하여 일상생활에 통증을 일으킨다. 또한, 관절 주변 조직에 과도한 충격을 주어서 관절 손상을 일으키기도 한다. 이로 인해 추후에는 보행 이상, 근력 감소, 퇴행성 고관절 또는 무릎 관절 등의 질환을 유발시킨다.[1] 따라서 유아기때 발달성 고관절 이형성증(Developmental Dysplasia of the Hip, DDH)을 조기 진단하는 것은 이를 효과적으로 치료하기 위해 아주 중요하다.[2,3,4]

발달성 고관절 이형성증을 진단하기 위해서는 현재 촉진을 통한 관절 검진과 영상을 통한 검진이 있다. 촉진을 통한 관절 검진은 오토라니 검진과 발로[5] 검진 등이 있다. 이 검사 방법은 경험이 부족한 검사자일 경우, 13 % ~ 24 %의 검진 진단률을 보여주었으며,[6,7] 경험이 풍부한 검사자일 경우 53 % ~ 60 %의 검진 진단률을 보였다.[6,8]

영상을 이용한 검진으로는 고관절 X-ray[9] 또는 초음파[10] 영상을 이용한 검진이 있다. 고관절 X-ray 및 초음파 영상을 이용했을 때 각각 검진 진단률이 약 78 %,[11] 86 % ~ 97 %,[11,12]로 보고되고 있다. 이는 촉진 진단에 비해 높은 검진 진단률을 보이나 영상을 이용한 방법 또한 검사자의 컨디션 또는 내·외부 환경 요인에 따라 진단 결과에 대한 차이가 발생할 가능성이 존재한다.

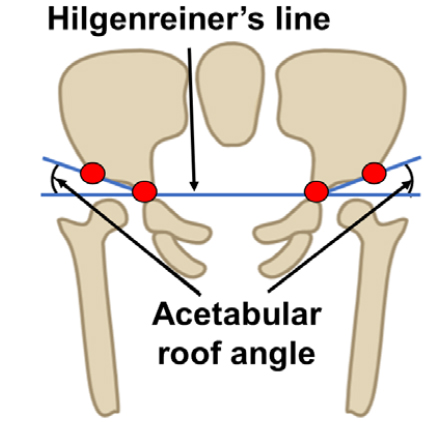

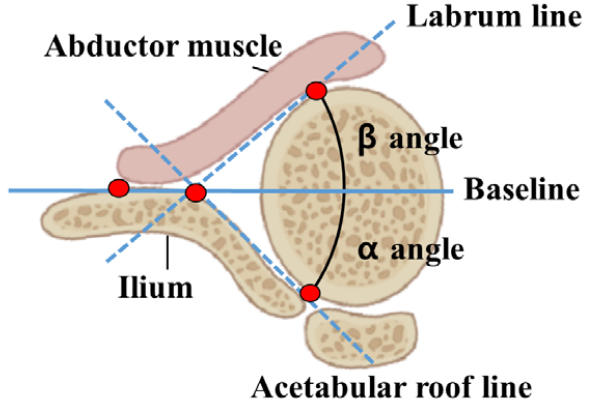

X-ray 영상을 이용한 검진으로는 Acetabular roof 각도, Shenton의 선의 위치, 대퇴골두의 비정상적인 위치 등의 기준을 종합하여 발달성 고관절 이형성증을 진단한다. 초음파 영상을 이용한 검진은 Graf의 기법에 근거하여 발달성 고관절 이형성증을 진단한다.[13] α 각도는 Baseline과 Acetabular roof의 선 사이의 각도를 나타내며, β 각도는 Baseline과 Labrum의 선 사이의 각도를 나타낸다. 본 논문은 발달성 고관절 이형성증을 진단하기 위해 X-ray영상에서는 Fig. 1과 같이 특징점 4개를 검출 후 Acetabular roof 각도를 구하는 것에 중점을 두었으며, 초음파 영상 기반에서는 Fig. 2와 같이 골 및 연골 형태를 특징점 4개를 검출 후 α, β 각도를 측정하여 진단하였다.

특징점 검출 알고리즘은 인체 또는 사물과 같은 특정 객체의 특징점을 식별하고 추정하는 기법이다. 딥러닝 기반의 특징점 검출 알고리즘은 컴퓨터 비전 및 패턴 인식 분야에서 주로 활용됐으며 객체 인식, 자세 추정, 동작 인식 등 다양한 응용 분야에 적용되고 있다.[14,15,16] 이를 기반으로 하여, 본 연구에서는 검사자가 X-ray 또는 초음파 영상을 기반으로 발달성 고관절 이형성증 진단 시 특징점 검출 과정에 대한 신뢰성을 향상시키기 위해 특징점 검출 딥러닝 모델을 개발하였으며 다양한 데이터 증강 기법에 따른 특징점 검출 결과를 X-ray 및 초음파 영상을 이용해 각각 비교 평가하였다.

II. 연구 및 실험 방법

2.1 고관절 이형성증 X-ray 및 초음파 영상 데이터셋 준비

DDH 진단을 위한 딥러닝 기반 특징점 검출 알고리즘을 개발 및 비교 평가하기 위해 X-ray 및 초음파 영상 데이터셋을 각각 303개와 2,461개를 준비하였다. 본 연구에서는 Mendeley data에서 무료로 제공되는 영유아 고관절 X-ray 영상 데이터셋을 활용하였다.[17] 해당 데이터셋은 영유아 고관절 X-ray 영상을 포함하며, 피험자의 평균 연령은 4.5 ± 0.83개월이며 DDH 및 정상 환자를 포함한다(DDH 73명, 정상 230명). 또한, 초음파 영상 데이터셋 피험자의 연령은 0세 ~ 6세이며 DDH 346명, 정상 환자 2,115명을 포함한다. Fig. 3과 같이 딥러닝 모델 훈련 및 검증을 위해 고관절 X-ray 및 초음파 영상의 특징점을 CVAT 및 custom 프로그램을 이용해 수동으로 비구의 윤곽에 4개의 특징점을 각각 표시 및 Ground Truth를 획득하였다.

2.2 영상 전처리

본 연구에서는 딥러닝 모델의 입력 크기를 1 X 224 X 224이며, 영상의 비트 수는 8 bit이다. 영상의 전체적인 밝기 분포를 균일하게 조정하여 대비를 향상시키기 위해 히스토그램 평활화(Histogram Equalization)를 적용하였다. 또한, 3 X 3 윤곽선 향상 필터를 적용하여 이미지에서 객체의 윤곽을 강조하였다. 이러한 전처리 과정은 주로 경계 검출 알고리즘과 관련하여 사용되며, 객체와 특징점의 정확한 검출을 위한 중요한 단계이다.

2.3 특징점 검출을 위한 딥러닝 모델 및 훈련

전처리 과정을 거친 이미지를 입력으로 받아 영상에서의 특징점 좌표를 출력하는 특징점 검출 알고리즘을 구현하였다. Fig. 4는 본 연구에서 사용한 대표적인 딥러닝 모델인 Residual Network(ResNet)[18] 구조를 보여준다. ResNet은 딥러닝에서 깊은 신경망을 학습하는데 어려움을 해결하기 위해 제안된 모델이다. ResNet은 “잔차 학습”이라는 개념을 도입하여 네트워크의 깊이에 따른 기울기 소실 문제를 완화 시킨다. 이 구조는 스킵 연결(skip connection)이라는 구조를 사용하여 이전 층의 출력을 현재 층의 입력에 직접 추가함으로써 정보의 흐름을 보존한다. 특징점 검출 시 ResNet은 매우 깊은 네트워크 구조를 효과적으로 학습할 수 있으며, 특히 특징점의 다양한 크기와 형태를 식별하는 능력이 우수하다.[19] 또한, ImageNet Classfication with Deep Convolutional Neural Networks(AlexNet)[20]과 Visual Geometry Group Network(VGGNet)[21]을 개발하여 비교 분석하였다. AlexNet은 작은 필터 크기와 깊은 층을 특징으로 하는 모델이다. 이 모델은 이미지 인식 대회인 ImageNet Challenge에서 우승한 바가 있으며, 대량의 이미지 데이터를 효과적으로 학습하는 능력을 보여준다. VGGNet은 많은 합성곱과 풀링 계층을 쌓은 구조로 구성되어 있어 특징의 계층적인 추출을 가능하게 한다. 이 모델은 다양한 크기와 복잡도에 대해 강력한 특징 추출 성능을 보여주었다.

공통적으로 Adam Optimizer를 사용하고, SmoothL1Loss 함수를 사용하여 모델을 최적화하였다. 배치 크기는 32로 설정하였으며, 주기는 100으로 설정하였다. 초기 학습률은 0.001로 설정하고 10주기 동안 검증 손실이 개선되지 않을 경우 ReduceLROnPlaeau 함수를 사용하여 학습률을 ‘현재 학습률 X 0.1’로 조정하고 재학습을 수행하였다.

확보된 데이터셋 중 트레이닝을 위해 X-ray 영상 290개, 초음파 영상 2,400개를 사용하였다. 훈련 및 검증을 9:1 비율로 진행하였으며, 학습 과정에서 특정 검증 데이터에 대한 편향을 방지하기 위해 10-fold 교차 검증을 이용하여 신뢰성을 향상시켰다.[22] 훈련 및 검증 이 후 X-ray 영상 13개, 초음파 영상 61개 사용하여 모델의 성능을 시험하였다.

2.4 데이터 증강(Data augmentation)

의료 영상 데이터의 특성상 대량의 데이터셋 확보가 쉽지 않기 때문에 이를 보완하기 위해 본 연구에서는 데이터 증강 기법을 적용하였다. 데이터 증강은 기존의 데이터를 변형하거나 확장하여 새로운 학습 데이터를 생성하는 방법이다. 이를 통해 데이터의 다양성과 양을 증가시키고, 모델의 일반화 성능을 향상시킬 수 있다.

본 연구에서 데이터 증강 기법을 Simple augmentation과 Complex augmentation 두 가지 범주로 구분하였다. Simple augmentation은 Zero padding(폭: 0 픽셀 ~ 100 픽셀, 높이: 0 픽셀 ~ 100 픽셀, 간격: 5 픽셀)[23]과 Rotation(각도: -90° ~ +90°, 간격: ±5°)[24,25]을 포함하며, Complex augmentation은 Elastic transform(ET, 스케일: 0.01 ~ 0.05),[25] Gaussian noise(GN, 분산 한계 10 ~ 50, 평균 분포: 0.0),[24,25] Random brightness contrast(RBC, 밝기 한계: -0.2 ~ +0.2, 대비 한계: -0.2 ~ +0.2)[25,26]를 포함한다(Fig. 5). 각 증강기법의 영향을 평가하기 위해 기존의 훈련 데이터셋인 X-ray 영상 290장, 초음파 영상 2,400장에 Simple & Complex augmentation을 적용하였다. Simple augmentation을 적용하여 X-ray 영상에 3,654장 초음파 영상에 12,960장을 각각 생성하였다. 또한 Complex augmentation을 비교하였을 경우 X-ray 영상에 1,827장 초음파 영상에 6,480장을 각각 추가 생성하였다.

2.5 훈련 성능 분석 방법

Object Keypoint Similarity(OKS)는 특징점과 Ground Truth간의 유사성을 보여주는 지표 중 하나이다.[27] 일반적으로, OKS는 검출된 특징점과 Ground Truth 사이의 거리나 방향 차이를 측정하여 유사성을 평가한다. 이러한 측정 결과는 유사도 점수로 표현되며, 높은 점수는 Ground Truth와 검출된 특징점이 유사한 구성을 하고 있음을 나타낸다.

: 객체 세그먼트 영역

: Ground Truth와 검출된 특징점 사이의 Euclidean Distance

: Falloff를 제어하는 특징점마다 존재하는 상수

: Ground Truth의 Visibility Flag(검출기의 예측된 는 사용되지 않음)

Eq. (1)은 표준편차인 와 함께 정규화되지 않은 Gaussian 함수에 를 통과시킨 값을 의미합니다. 각 특징점에 대해 0과 1사이의 OKS을 계산한 값이 된다. 완벽한 예측일 때 OKS값은 1이 되고, 반대로 표준편차 에 대해 정규화되지 않은 가우스 함숫값이 0이 되면 OKS값은 0이 된다. 즉, Ground Truth와 검출된 특징점 사이의 Euclidean Distance가 작을수록 OKS값은 1에 가까워진다. 그러나 본 연구에서는 객체를 탐지하는 것이 아니므로, 는 입력 영상 크기인 1 X 224 X 224로 설정하였다. 또한, 모든 특징점에 대해 상수 를 0.009로 일정하게 설정하고 모든 특징점은 측정되므로 𝛿는 1로 설정하였다.

III. 실험 및 결과

3.1 특징점 검출 딥러닝 모델 비교 결과

본 연구에서는 X-ray 및 초음파 영상에 대해 독립적으로 인공신경망을 훈련하고 평가를 수행하였다. Table 1은 X-ray 및 초음파 영상에 대한 각 모델의 성능을 보여준다. 여기서 훈련에 사용될 X-ray 및 초음파 영상은 각각 261장과 2,160장이다. AlexNet의 평균 OKS는 각각 7.04 ± 2.58, 17.13 ± 3.42로 측정되었으며, VGG16Net의 평균 OKS는 각각 3.96 ± 1.41, 5.43 ± 1.52로 측정되었다. ResNet50의 평균 OKS는 각각 29.74 ± 4.06, 43.91 ± 6.63로 가장 높게 측정되었다. 특징점 검출 성능을 향상시키기 위해 ResNet 모델의 layer 조정 및 데이터 증강 기법을 적용하였다.

Table 1.

Average training OKS with confidence interval at 95 % for each deep learning model in keypoint detection.

| Models | Average training OKS (95 % CI) | |

| X-ray | Ultrasound | |

| AlexNet | 7.04 ± 2.58 | 17.13 ± 3.42 |

| VGG16Net | 3.96 ± 1.41 | 5.43 ± 1.52 |

| ResNet50 | 29.74 ± 4.06 | 43.91 ± 6.63 |

Table 2는 X-ray 및 초음파 영상에 대한 ResNet 모델을 다양한 레이어와 Simple augmentation 기법을 동시에 적용했을 때의 평균 OKS를 보여준다. 전 비교연구에서 Simple augmentation 기법을 활용하여 훈련 데이터로 사용될 X-ray 및 초음파 영상은 각각 3,654장과 12,960장을 추가하여 총 3,915장과 15,120장이다. 각 레이어 별 ResNet 모델의 평균 OKS는 다음과 같다: 먼저, X-ray 영상에 대한 ResNet18의 평균 OKS는 각각 44.47 ± 6.00, ResNet32의 평균 OKS는 54.82 ± 8.24, ResNet50의 평균 OKS는 63.78 ± 7.71, ResNet101의 평균 정밀도는 57.58 ± 9.41이며, ResNet152는 평균 정밀도가 67.23 ± 10.12로 측정되었다. 다음으로, 초음파 영상에 대한 ResNet18의 평균 OKS는 각각 70.62 ± 6.83, ResNet32의 평균 OKS는 75.23 ± 6.35, ResNet50의 평균 OKS는 75.11 ± 6.34, ResNet101의 평균 OKS는 75.46 ± 5.36이며, ResNet152는 평균 OKS가 77.88 ± 6.00로 측정되었다. 특히, ResNet152는 다른 모델들에 비해 가장 높은 평균 정밀도를 보여주었다. 따라서, 본 연구의 추가 실험에서는 ResNet152를 선택하여 활용하였다.

Table 2.

Average training OKS with confidence interval at 95 % for a combination of different layers of ResNet with simple augmentation in keypoint detection.

추가적으로 Complex augmentation 기법을 각각 적용한 특징점 검출에 관한 딥러닝 모델의 성능을 평가하였다(Table 3). Complex augmentation 기법을 활용하여 훈련 데이터로 사용될 X-ray 및 초음파 영상은 각각 1,827장과 6,480장을 추가하여 총 5,742장과 21,600장이다. X-ray 영상에 대한 실험 결과, GN는 평균 OKS는 67.92 ± 12.31, RBC는 평균 OKS 73.09 ± 9.92, ET는 평균 OKS 86.54 ± 5.18로 측정되었다. 초음파 영상에 대한 실험 결과, GN는 평균 OKS는 76.80 ± 6.16, RBC는 평균 OKS 80.20 ± 5.82, ET는 평균 OKS 80.26 ± 5.60로 측정되었다. X-ray 및 초음파 영상에서의 실험결과, RBC와 ET를 적용하였을 때 특징점 검출에 관한 높은 OKS를 보였다. 반면, GN은 standard기법인 ResNet 152 + Simple augmentation과 거의 유사한 성능을 보여주었다.

Table 3.

Average training OKS with confidence interval at 95 % for a combination of different complex augmentation techniques with ResNet152 in keypoint detection.

3.2 고관절 X-ray 및 초음파 영상에서의 특징점 검출 결과

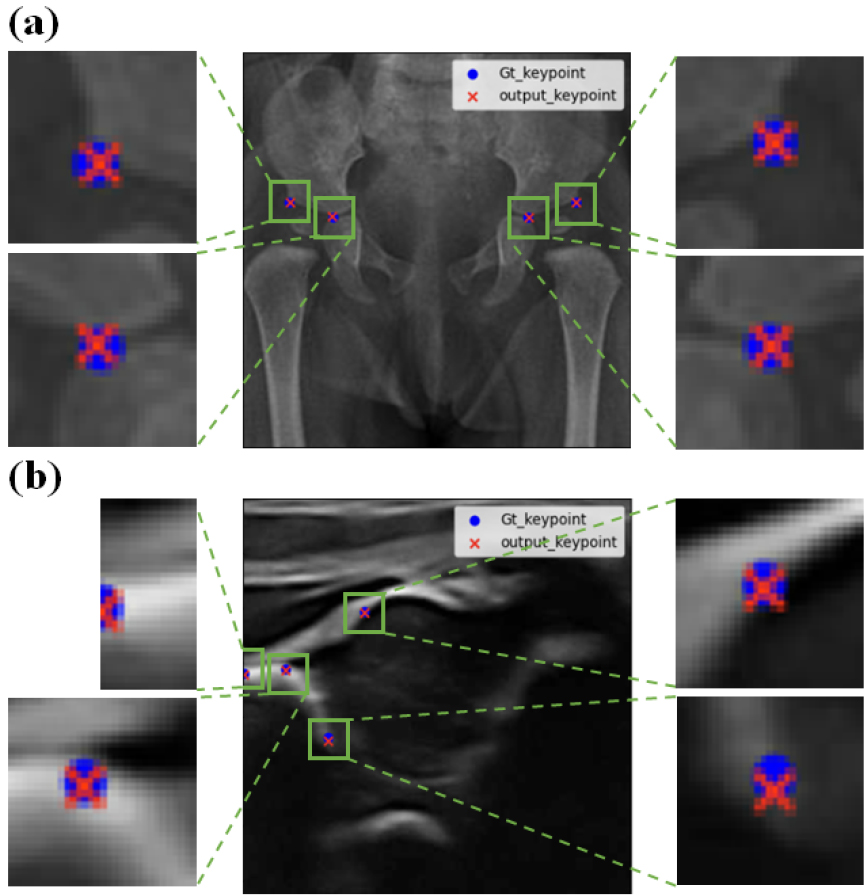

앞 절의 실험 결과에 따라 추후 실험에서는 DDH 진단을 위한 특징점 추출에 ResNet152와 Simple(zero-padding, rotation) & Complex(RBC, ET) Augmentation 기법을 동시에 적용하였다. 최종적으로 Simple(Zero-padding, Rotation) & Complex(RBC, ET) Augmentation 기법을 활용하여 훈련 데이터로 사용될 X-ray 및 초음파 영상은 각각 총 7,569장과 28,080장이다. Fig. 6는 고관절 X-ray 및 초음파 영상에서 검출된 특징점을 보여준다. Table 4는 이러한 방법을 사용하여 고관절 X-ray 및 초음파 영상 특징점 검출에 관한 평균 OKS를 나타내었다. 고관절 X-ray 영상에 관한 평균 OKS는 95.33 ± 2.64, 초음파 영상은 평균 OKS 81.21 ± 6.07로 측정되었다.

Table 4.

Average training OKS with confidence interval at 95 % for a different type of images in keypoint detection using the proposed method.

| Type of hip joint image | Average training OKS (95 % CI) |

| X-ray | 95.33 ± 2.64 |

| Ultrasound | 81.21 ± 6.07 |

3.3 검출된 특징점을 이용한 고관절 이형성증에 관한 각도 측정

고관절 X-ray 영상과 초음파 영상에서 측정된 특징점을 활용하여 Fig. 7와 같이 각도를 측정하는 알고리즘을 구현하고 Ground Truth와의 각도 차이를 분석하였다. 결과적으로 X-ray 영상에서는 좌측 비구에 관한 기울기 각도 차이는 0.23 %, 우측 비구에 관한 기울기 각도 차이는 0.25 % 로 측정되었다. 고관절 초음파 영상에서는 α 각도의 차이는 0.06 %, β 각도의 차이는 0.57 %로 측정되었다.

IV. 결론 및 향후 계획

본 연구에서는 DDH 진단을 위한 특징점 검출 알고리즘을 제안하였으며, 고관절 X-ray과 초음파 영상을 이용하여 비교 평가하였다. 특징점 검출을 위해 ResNet152가 가장 높은 성능을 보였으며, 데이터 증강을 위해 Zero-padding, Rotation, RBC, ET 동시 적용은 모델의 성능을 향상시키는데 크게 기여하였다. 이를 통해 고관절 X-ray 및 초음파 영상의 특징점 검출에 관한 평균 OKS를 각각 95.33 % 및 81.21 %로 향상시킬 수 있었다. 이러한 결과는 본 연구에서 제안한 딥러닝 모델이 DDH 진단을 위한 객관성과 생산성을 향상시킬 수 있음을 시사한다.

초음파 영상은 X-ray 영상과 비교하면 상대적으로 낮은 평균 정밀도를 보여주었다. X-ray 영상에 비해 초음파 영상이 스페클(speckle) 대조도가 낮은 한계를 가지고 있다. 이러한 한계로 인해 특징점 검출 딥러닝 모델이 초음파 영상에서의 특징점을 찾는데 어려움을 갖는 것으로 보고되었다.[28,29,30] 그러나 또 다른 연구에서는 대퇴골두와 Acetabular Roof에 Semantic Segmentation 기술을 적용하여 α 각도를 정밀하게 측정할 가능성을 보여주었다.[31] 이 기술을 기반으로 하여, 추후 연구에서는 대퇴골두와 관련된 Semantic Segmentation 기술의 도입을 계획하고 있다. 또한, 현 연구에서 활용한 baseline의 특징점들과 접선을 이용하여 Acetabular Roof와 Labrum의 윤곽선을 정의하고, 이를 통해 α와 β 각도를 측정할 예정이다. 이러한 방법이 초음파 영상을 통한 발달성 고관절 이형성증 검진의 정확도를 향상시킬 것으로 기대된다.