I. 서 론

II. 고려할 카메라 변수

2.1 프레임 속도

2.2 셔터 속도

2.3 픽셀 당 실제 길이

III. 단일 점의 2차원 진동 측정 및 교정

3.1 진동체의 기준 위치 추적 방법

3.2 단일 점의 직선 진동 측정

3.3 카메라 측정의 교정

IV. 다중 점의 2차원 진동 측정

4.1 회전 진동 측정

4.2 외팔보의 다중 점 진동 측정

4.2.1 랜덤 가진

4.2.2 고유 진동수 가진

V. 결 론

I. 서 론

구조물의 진동 측정은 구조물의 안전 진단 또는 운동 특성 파악 등 여러 분야에서 사용되고 있다. 구조물의 진동을 정확히 측정하기 위해 가속도계나 LDV(Laser Doppler Vibrometer) 등의 장비가 사용되며, 이러한 진동 측정 방법들은 특정한 지점에서의 진동을 매우 정확하게 측정할 수 있다는 큰 장점을 갖고 있다. 그러나 이는 센서 하나당 한 지점이나 방향에 한정하여 측정할 수밖에 없다는 단점이 있다. 예를 들어, LDV 한 대를 이용하면 레이저가 조사되는 지점과 방향에 한정된 진동만 측정할 수 있다.[1] 이 경우 만약 여러 지점과 방향의 진동을 동시에 측정하고 싶다면 그만큼 많은 개수의 측정 장비가 필요하며 이는 더 많은 비용을 유발한다. 따라서 최근 이러한 단점을 극복하기 위해 이미지를 이용한 진동 측정에 대한 연구가 활발히 진행되고 있다.[2,3]

이미지를 이용한 진동 측정은 카메라 등의 이미지 센서를 이용하여 구조물에서 일어나는 진동의 형태를 이미지로 포착하고 그로부터 진동을 분석하는 방식의 측정법이다. 물론 기존의 측정 방식보다 정확도나 정밀성 면에서 성능이 떨어질 수 있다는 단점을 갖고 있으나, 카메라 한 대를 이용하여 화면내의 모든 관심 점과 방향의 진동을 동시에 측정할 수 있다는 큰 장점을 갖고 있다. 따라서 기존의 측정법과는 다르게 측정 지점과 방향의 개수만큼 카메라가 필요한 것이 아니기 때문에 측정하고자 하는 지점이나 방향의 개수가 증가할수록 기존 방법에 비하여 경제성 면에서 더욱 유리해진다.

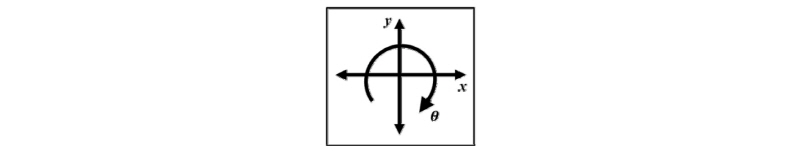

본 연구에서는 2016년 가치로 100만 원 이하의 저가의 머신 비전 카메라를 이용하여 2차원 평면상의 진동을 측정하였다. 2차원 평면상의 진동은 Fig. 1에서 나타낸 3가지 자유도에 관한 진동을 의미한다. 먼저 진동 측정 시 고려할 카메라 변수에 대하여 알아본 후, 하나의 표시 점을 이용하여 단일 점에 대한 직선 진동 운동을 측정하였다. 카메라와 LDV로 동시에 측정하였고, LDV 값을 교정 기준으로 하여 진동 측정 기구로서의 카메라에 대한 교정을 실험적으로 수행하였다. 여러 개의 표시 점을 이용하여 다중점과 방향에 대한 운동을 한 번에 측정하였고, 이를 이용하여 시간 및 주파수 영역에서의 진동을 분석하여 유용성을 보이고자 하였다.

II. 고려할 카메라 변수

우선 측정하고자 하는 대상 진동의 범위에 적합한 카메라의 몇 가지 주요 변수를 잘 고려해 주어야 대상 진동체의 진폭, 주파수, 위상에 적합한 카메라를 선정할 수 있다.[4] 진동에 정확한 측정에 가장 큰 영향을 주는 변수로 프레임 속도, 셔터 속도, 픽셀 당 실제 거리를 선정하였으며, 조리개의 크기, ISO 등의 변수는 실험에서 모두 일정하게 유지하였다. 또한 렌즈를 통해 발생하는 이미지의 왜곡인 렌즈 수차가 발생할 수 있으나 이는 대부분 렌즈 제조 시 물리적인 보정에 의해 해결되기 때문에 무시하였다. 기하학적 왜곡은 렌즈 화각이 약 75° 이상일 경우 발생하나 이는 3차원 물체에 대하여 발생하므로 2차원 진동에 대하여 다루는 본 논문에서는 고려하지 않아도 될 사항이다.[5]

2.1 프레임 속도

프레임 속도란, 초당 연속적으로 촬영하는 프레임 수를 일컫는다. 카메라로 물체의 진동을 측정한다는 것은 아날로그적인 물체의 움직임을 디지털적으로 저장하는 것이기 때문에 샘플링 간격이 중요하다. 따라서 신호의 왜곡을 초래하는 에일리어싱(Aliasing)을 방지하기 위해서는 최대 한계 주파수인 나이퀴스트 주파수  (Nyquist frequency)를 고려해야 한다.[6] 샘플링 간격이

(Nyquist frequency)를 고려해야 한다.[6] 샘플링 간격이  일 때,

일 때,  은 아래 Eq. (1)과 같다:

은 아래 Eq. (1)과 같다:

, (1)

, (1)

여기서 카메라의 프레임 속도가  fps라면 이론적으로 최대

fps라면 이론적으로 최대  Hz의 진동까지 측정이 가능하다. 즉, 카메라의 프레임 속도는 진동체의 주파수와 연관되는 변수이다. 단, 실시간 이미지 처리를 한다면 나이퀴스트 주파수와는 별도로 측정 가능한 주파수에 한계가 생긴다. 만약 한 장의 이미지를 처리하는데

Hz의 진동까지 측정이 가능하다. 즉, 카메라의 프레임 속도는 진동체의 주파수와 연관되는 변수이다. 단, 실시간 이미지 처리를 한다면 나이퀴스트 주파수와는 별도로 측정 가능한 주파수에 한계가 생긴다. 만약 한 장의 이미지를 처리하는데  s의 시간이 걸리면, 이론적으로 실시간 처리의 경우에

s의 시간이 걸리면, 이론적으로 실시간 처리의 경우에  Hz의 진동까지 측정이 가능하다. 하지만 본 논문에서는 이미지를 먼저 수집한 후 이미지처리를 했기 때문에 실시간 처리 속도를 고려하지는 않았다.

Hz의 진동까지 측정이 가능하다. 하지만 본 논문에서는 이미지를 먼저 수집한 후 이미지처리를 했기 때문에 실시간 처리 속도를 고려하지는 않았다.

2.2 셔터 속도

셔터 속도는 촬영 시 카메라의 셔터가 열려 빛이 노출되는 시간을 가리킨다. 셔터가 열려있는 동안 움직인 피사체의 궤적이 모두 이미지 센서에 기록되기 때문에 셔터 속도에 따라 블러링이 일어나는 정도가 다르다. 만약 카메라의 셔터 속도가  s라면

s라면  s 동안 진동체가 이동한 변위가 블러링으로서 이미지에 그대로 기록되게 된다. 따라서 진동체의 진폭이

s 동안 진동체가 이동한 변위가 블러링으로서 이미지에 그대로 기록되게 된다. 따라서 진동체의 진폭이  m이고 주파수가

m이고 주파수가  Hz라면 단일 주파수의 진동에서 나타날 수 있는 블러링의 범위는 아래 Eq. (2)와 같다.

Hz라면 단일 주파수의 진동에서 나타날 수 있는 블러링의 범위는 아래 Eq. (2)와 같다.

. (2)

. (2)

즉, 셔터 속도는 진동의 주파수와 진폭 모두에 관련된 변수라고 할 수 있다.

2.3 픽셀 당 실제 길이

픽셀 당 실제 길이란 이미지 센서의 픽셀 하나의 한 변이 나타내는 실제 세상의 길이를 의미한다. 이를 결정하는 요소는 두 가지가 있는데 첫 번째는 이미지 센서의 해상도이고 두 번째는 카메라와 피사체 사이의 거리이다.[5] 해상도가 높아질수록, 거리가 가까워질수록 픽셀 하나가 나타내는 실제 길이는 점점 작아진다. 진동체의 움직임을 측정하는 것은 프레임 속도가  fps일 때 기준점이

fps일 때 기준점이  초 동안 픽셀 단위에서 어떻게 움직였는가를 측정하는 것이다. 길이와 시간 요소를 모두 고려해야 하므로 픽셀 당 실제 길이는 진동의 진폭과 주파수 모두에 관련된 변수이다.

초 동안 픽셀 단위에서 어떻게 움직였는가를 측정하는 것이다. 길이와 시간 요소를 모두 고려해야 하므로 픽셀 당 실제 길이는 진동의 진폭과 주파수 모두에 관련된 변수이다.

III. 단일 점의 2차원 진동 측정 및 교정

본 절에서는 일단 단일 점의 진동을 카메라로 측정한 내용을 다루기 위해, 먼저 진동체 움직임의 포착하는 방법을 연구하고, 외팔보를 대상으로 진동을 측정하였다. 카메라와 LDV 측정을 동시에 진행함으로써, LDV 측정값을 교정 기준으로 하여 진동 측정 기구로서의 카메라가 어느 정도의 오차를 갖고 진동을 측정할 수 있는지에 대하여 교정을 수행하였다.

3.1 진동체의 기준 위치 추적 방법

카메라를 이용하여 구조물의 진동을 측정하기 위해서는 일단 이미지 상의 기준이 되는 위치를 추출하여 그 기준 점의 운동을 추적해야 한다. 이를 위해 두 가지 이미지 처리 기법이 사용될 수 있는데, 직접법과 형상 기반법이 있다. 직접법은 물체 본연의 밝기가 변하지 않는다고 가정하고 개별 픽셀의 밝기 정보를 가중치로 하여 픽셀 한 개에 해당하는 좌표값 이하의 소수점 단위 좌표를 계산하는 방법이다. 이 방법은 기준 점의 위치를 정밀히 계산할 수 있는 장점이 있지만 물체의 밝기가 크게 변할 때는 사용할 수 없는 단점이 있다.[7] 형상 기반법은 픽셀 각각의 정보를 이용하는 것이 아니라 대상 물체의 전체적 모양을 이용하는 방법이다. 직접법과는 달리 소수점 단위까지의 좌표 계산은 하지 못하나, 물체의 밝기 변화에 따른 오차는 매우 작다는 장점이 있다. 따라서 이 방법은 기준 점의 이동 거리가 픽셀 하나를 넘어설 정도로 크고, 물체의 밝기가 일정하지 않을 때 사용하기 적합하다.[8] 물체의 진동을 측정할 때 이 두 가지 방법을 각각 또는 혼용해서 사용할 수 있다. 또한 이러한 이미지 처리 기법을 사용할 때 별도의 표시 점을 진동체에 부착할 수도 있고, 표시 점을 부착하지 않고 진동체의 특정 부분의 형상을 이용할 수도 있다.

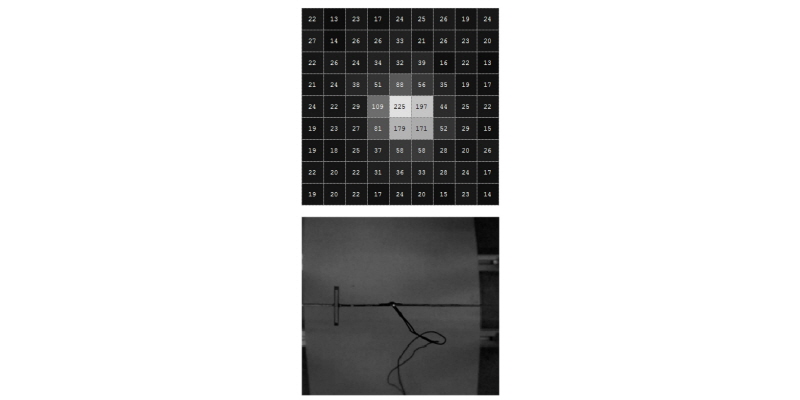

본 연구에서는 직접법과 표시 점을 부착하는 방식을 채택하였다. 직접법을 채택한 이유는 본 연구에서 픽셀 당 실제 거리 이하의 진폭을 다루기 때문에 픽셀 좌표를 소수점 단위까지 계산할 수 있어야 하기 때문이다. 또, 블러링이 거의 발생하지 않도록 최대한 빠른 셔터 속도를 사용했기 때문에 어두운 이미지에서의 기준 점 식별을 위하여 빛을 내는 LED(Light Emitting Diode)를 표시 점으로 사용하였다. Fig. 2는 LED 표시 점의 형상을 실제 이미지로 포착한 모습의 예이다. 여기서 LED 빛의 방사 형태가 가우스(Gauss) 분포를 이룬다는 점에 착안하여, LED의 형상에 가우시안 곡선을 맞춤하여 밝기의 피크 지점을 추적하였다.[9] 2차원 가우스 곡선의 형상은 아래 Eq. (3)과 같이 나타낼 수 있다:

. (3)

. (3)

위 식에서  는 밝기의 피크 지점을 나타내는데, 픽셀의 밝기 정보를 이용하여 이 피크 지점의 좌표를 찾는 것이 곡선 맞춤의 목적이다. 즉, 물체의 진동을 측정하기 위하여 표시 점을 나타내는 면적 중에서 가장 밝은 점을 기준 점으로 정하여 이 점의 위치를 추적하는 것이다.[10]

는 밝기의 피크 지점을 나타내는데, 픽셀의 밝기 정보를 이용하여 이 피크 지점의 좌표를 찾는 것이 곡선 맞춤의 목적이다. 즉, 물체의 진동을 측정하기 위하여 표시 점을 나타내는 면적 중에서 가장 밝은 점을 기준 점으로 정하여 이 점의 위치를 추적하는 것이다.[10]

3.2 단일 점의 직선 진동 측정

이미 언급되었듯이 카메라의 교정을 위하여 단일 점의 진동 측정 실험을 수행하였다. 교정에 대한 자세한 내용은 3.3절에서 다루며, 본 절에서는 수행한 실험 내용에 대하여 다룬다.

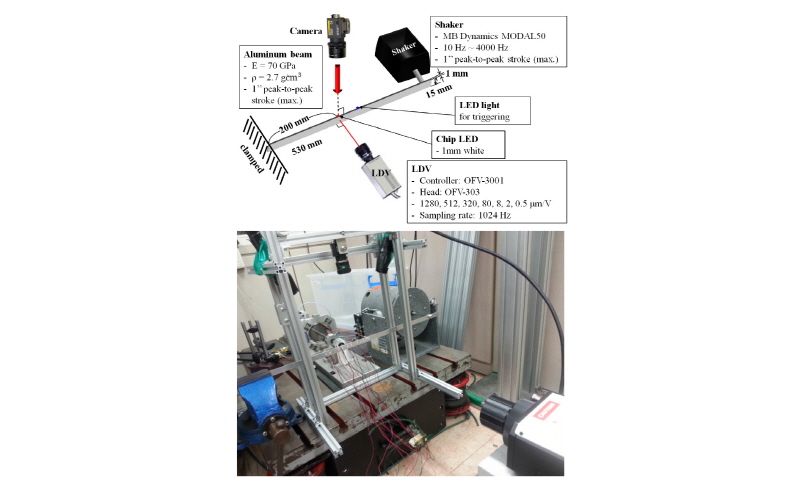

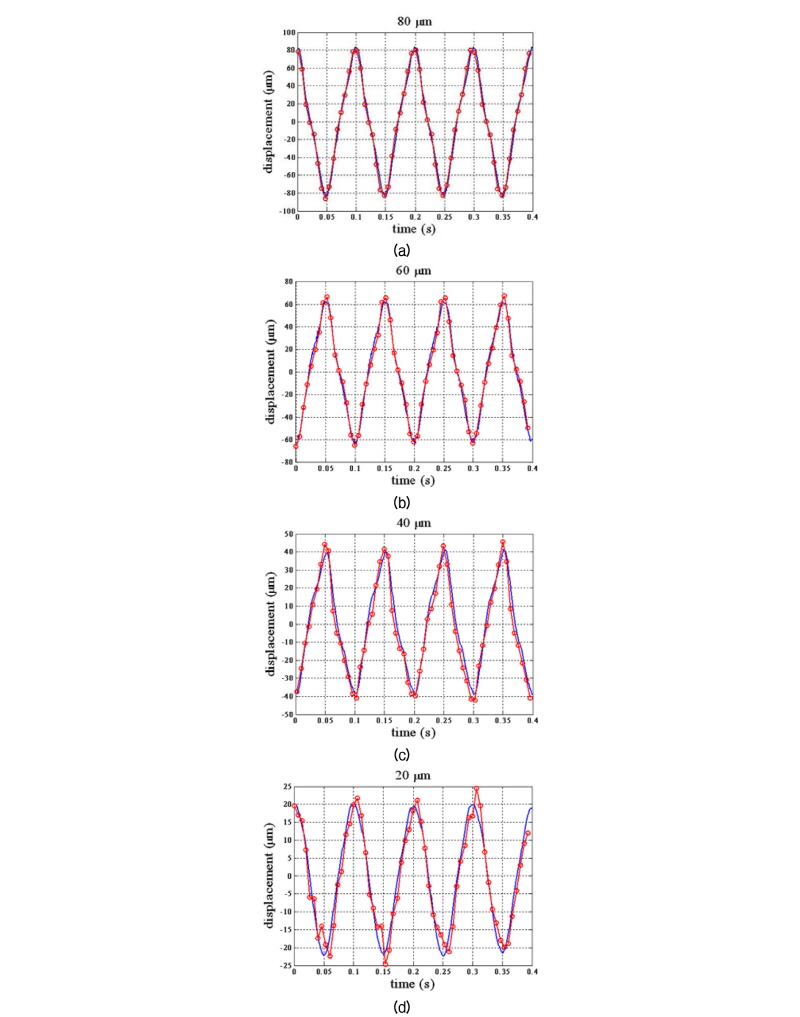

실험은 Fig. 3에 보여진 것처럼 카메라와 LDV를 동시에 설치하고 외팔보의 측면에 표시 점을 부착한 뒤 대형 가진기로 가진을 하였다. 카메라는  fps의 머신 비전 카메라를 사용하였으며, 100 µm까지의 진폭을 측정한다고 했을 때 Eq. (2)에 의해 블러링이 최대 진폭의 1 % 미만으로 발생하도록 셔터 속도는 0.01 ms로 설정하였다. 픽셀 당 실제 길이는 41.5 µm/pixel, 81.4 µm/pixel, 160 µm/pixel의 세 경우에 대해 실험하였고, 이는 100 µm를 기준으로 설정된 값들이다. 표시 점은 세 가지 주파수 10 Hz, 38 Hz, 75 Hz와 15 가지 진폭 0.5 µm, 1 µm, 2 µm, 3 µm, 4 µm, 6 µm, 8 µm, 10 µm, 20 µm, 30 µm, 40 µm, 50 µm, 60 µm, 80 µm, 100 µm 총 45가지의 조건을 변화시켜 가진하였다. 본 실험의 목적은 진동체가 나이퀴스트 주파수 이하의 어느 주파수로 진동을 할 때, 진동의 진폭이 줄어듦에 따라 LDV 측정과 비교한 카메라 측정의 오차를 계산하는 것이므로, 주파수보다 진폭을 더욱 세밀하게 나누었다. Fig. 4는 카메라와 LDV로 단일 점을 측정한 몇 가지 결과를 시간 축에 나타낸 그래프이다.

fps의 머신 비전 카메라를 사용하였으며, 100 µm까지의 진폭을 측정한다고 했을 때 Eq. (2)에 의해 블러링이 최대 진폭의 1 % 미만으로 발생하도록 셔터 속도는 0.01 ms로 설정하였다. 픽셀 당 실제 길이는 41.5 µm/pixel, 81.4 µm/pixel, 160 µm/pixel의 세 경우에 대해 실험하였고, 이는 100 µm를 기준으로 설정된 값들이다. 표시 점은 세 가지 주파수 10 Hz, 38 Hz, 75 Hz와 15 가지 진폭 0.5 µm, 1 µm, 2 µm, 3 µm, 4 µm, 6 µm, 8 µm, 10 µm, 20 µm, 30 µm, 40 µm, 50 µm, 60 µm, 80 µm, 100 µm 총 45가지의 조건을 변화시켜 가진하였다. 본 실험의 목적은 진동체가 나이퀴스트 주파수 이하의 어느 주파수로 진동을 할 때, 진동의 진폭이 줄어듦에 따라 LDV 측정과 비교한 카메라 측정의 오차를 계산하는 것이므로, 주파수보다 진폭을 더욱 세밀하게 나누었다. Fig. 4는 카메라와 LDV로 단일 점을 측정한 몇 가지 결과를 시간 축에 나타낸 그래프이다.

3.3 카메라 측정의 교정

카메라를 진동 측정 장비로 이용하기 위해서는 다른 측정 센서들과 마찬가지로 교정의 과정이 꼭 필요하다. 본 연구에서는 LDV의 측정 값을 교정 기준으로한 상대적 교정법을 채택하였다. 계산된 결과는 최종적으로 교정 차트의 형태로 나타내었다.

측정 오차는 교정 기준인 LDV 측정 값을 참 값으로 가정하고, 카메라와 LDV 측정 결과 사이의 평균 제곱근 오차(Root Mean Square Error, RMSE)의 계산을 통하여 분석하였다. RMSE의 계산 법은 아래의 Eq. (4)와 같다.

, (4)

, (4)

여기서  는 LDV로 측정한 데이터,

는 LDV로 측정한 데이터,  는 카메라로 측정한 데이터를 나타낸다. 여기서 RMSE 값을 해당 조건에서의 진폭

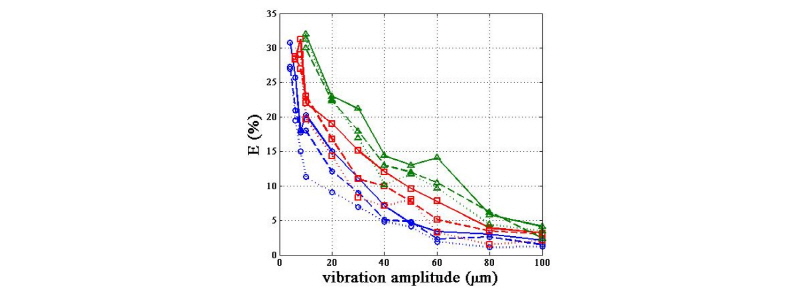

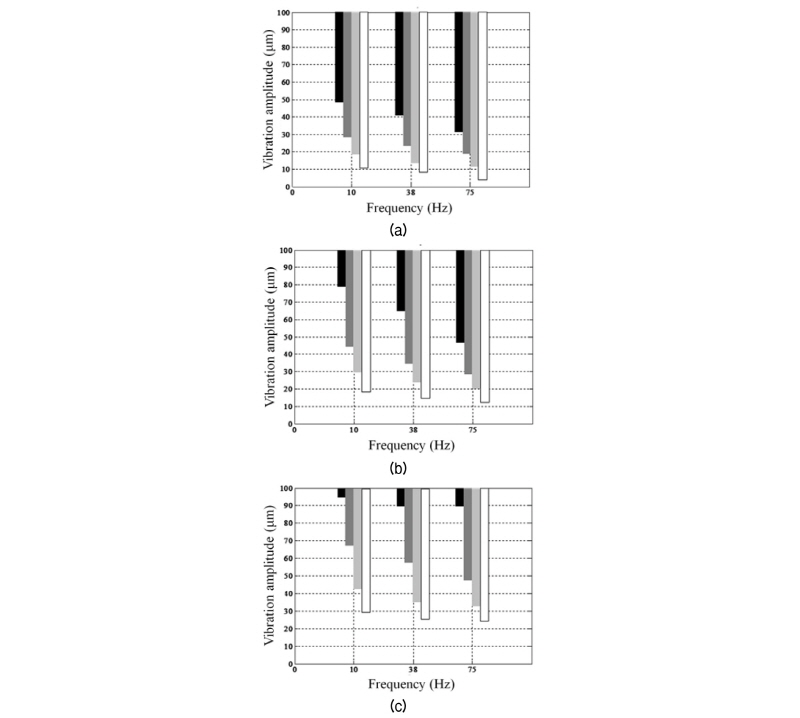

는 카메라로 측정한 데이터를 나타낸다. 여기서 RMSE 값을 해당 조건에서의 진폭  로 나누면 오차를 계산할 수 있으며 이는 아래 식과 같다. 측정한 실험 조건들 각각에 대하여 오차를 계산한 결과가 Fig. 5에 보여지고 있다.

로 나누면 오차를 계산할 수 있으며 이는 아래 식과 같다. 측정한 실험 조건들 각각에 대하여 오차를 계산한 결과가 Fig. 5에 보여지고 있다.

. (5)

. (5)

이 결과를 이용하여 본 실험의 궁극적인 목표라고 할 수 있는 카메라 교정 차트를 얻을 수 있다. 위의 각 결과에 대하여 3차 다항식으로 곡선 맞춤을 하고, 곡선 맞춤한 그래프를 이용하여 각 픽셀 당 실제 길이 조건에서 특정 주파수에 대한 오차 범위가 각각 5 %, 10 %, 15 %, 20 %에 들어오는 최소 진폭의 한계가 어느 정도인지를 교정 차트로서 나타낼 수 있으며 이는 Fig. 6에 나타낸 바와 같다. 본 차트를 이용하면, 프레임 속도가 150 fps이고, 셔터 속도는 0.01 ms인 카메라가 가우시안 곡선 맞춤 표시 점 추적법을 이용할 어느 정도의 오차 범위 내에서 진동을 측정할 수 있는지 알 수 있다.

Fig. 5.

Error E of various parametric conditions of camera and vibration: , 41.5 m/pixel and 10 Hz;

, 41.5 m/pixel and 10 Hz;  , 41.5 µm/pixel and 38 Hz;

, 41.5 µm/pixel and 38 Hz;  , 41.5 µm/pixel and 75 Hz;

, 41.5 µm/pixel and 75 Hz;  , 81.4 µm/pixel and 10 Hz;

, 81.4 µm/pixel and 10 Hz;  , 81.4 µm/pixel and 38 Hz;

, 81.4 µm/pixel and 38 Hz;  , 81.4 µm/pixel and 75 Hz;

, 81.4 µm/pixel and 75 Hz;  , 160 µm/pixel and 10 Hz;

, 160 µm/pixel and 10 Hz;  , 160 µm/pixel and 38 Hz;

, 160 µm/pixel and 38 Hz;  , 160 µm/pixel and 75 Hz.

, 160 µm/pixel and 75 Hz.

IV. 다중 점의 2차원 진동 측정

앞서 카메라로 진동을 측정하는 가장 큰 장점은 여러 지점과 방향에 대한 진동을 카메라 한 대로 한 번에 측정할 수 있다는 것이라 하였다. 따라서 본 절에서는 다중 표시 점을 이용하여 측정한 실험 결과에 대하여 다루며, 이를 위해 총 두 가지 실험을 수행하였다. 먼저 다중 표시 점을 이용하여 직선과 회전 운동을 동시에 측정하였고, 다음으로는 다중 표시 점을 이용해 외팔보의 전체 진동을 측정한 후 주파수 분석도 수행하였다.

4.1 회전 진동 측정

총 4개의 다중 표시 점을 이용하여 직선 진동 운동과 동시에 회전 진동 운동을 측정한 실험을 수행하였다. 본 실험에서는 앞서 사용한 표시 점을 추적하는 방식을 동일하게 사용하여, 외팔보가 진동을 할 때 굽힘에 의해 일어나는 평면 상의 회전 진동과 그 양 옆의 직선 진동 운동을 동시에 측정하였다.

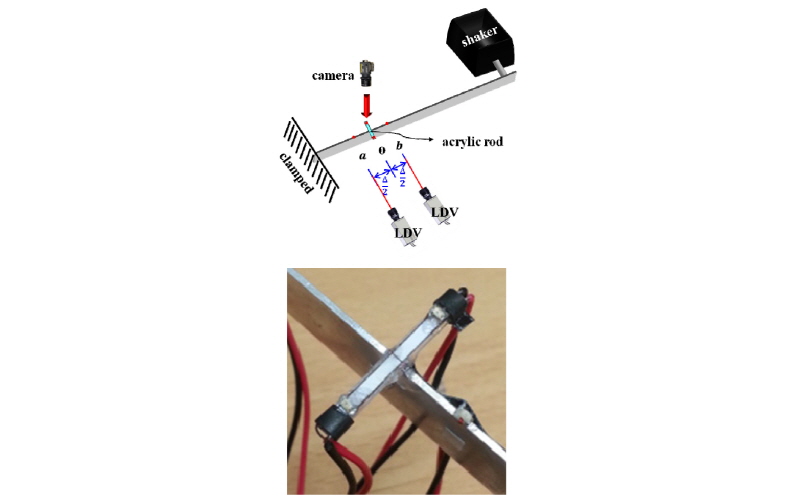

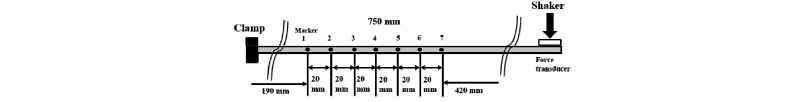

실험은 앞의 3절의 실험과 동일한 설정을 사용하였으며 이는 Fig. 7과 같다. 단, 이번 실험에서는 외팔보에 18 mm 길이의 아크릴 막대를 부착하고 막대의 양 끝 단에 LED를 부착하였다. 외팔보가 진동하는 상태일 때 아크릴 위의 두 LED를 연결한 직선의 기울기와 정지되어 있는 상태일 때의 직선의 기울기를 비교하여 회전한 각도를 측정하였다. 회전 진동의 측정 오차 계산을 위하여, 아크릴 막대 양 옆에 LED를 부착하여 그 두 지점의 직선 진동 운동을 측정하고 수치 미분 값을 계산하였다. 또한 검증을 위해 직선 진동 운동을 측정하는 위치에서 LDV로 동시에 측정을 진행하였다. 여기서 양 옆 지점은 외팔보의 파장 값에 의거한 최적 위치로 지정하였다.

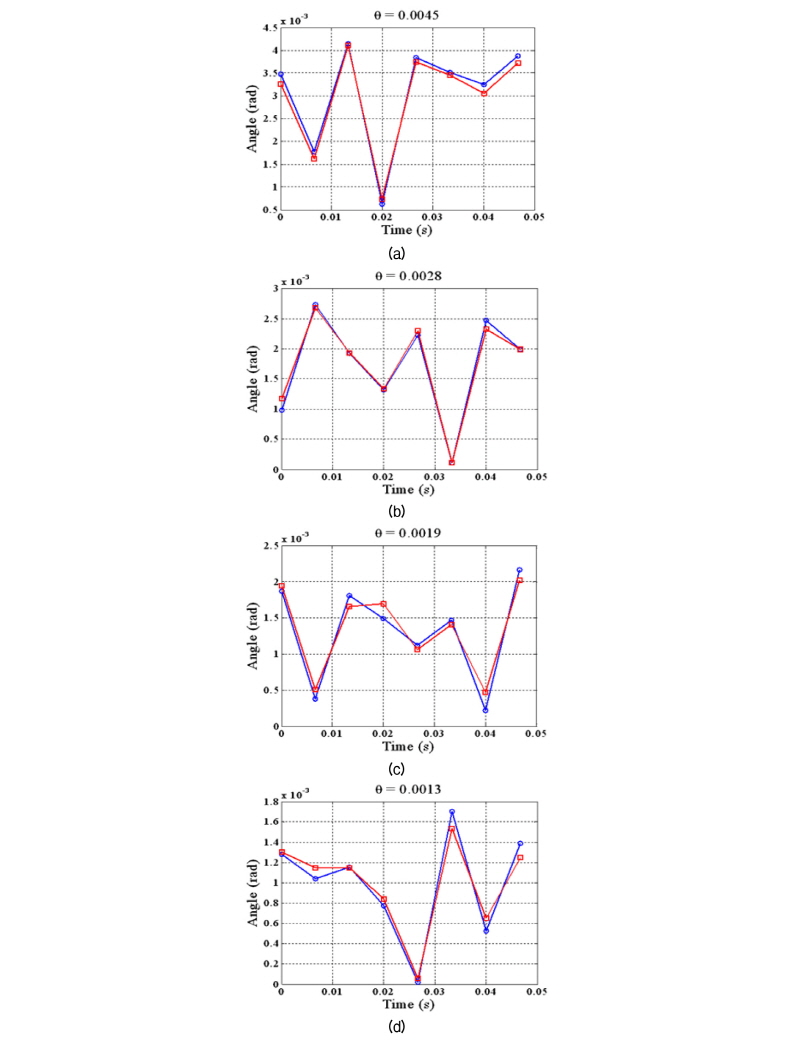

본 실험에서는 회전한 각도 포착의 용이성을 위해 외팔보가 공진 상태에 있을 때의 조건인 42 Hz로 가진을 하여 측정을 하였다. 카메라의 설정은 위의 실험과 동일하게 하였으며 픽셀 당 실제 길이는 81.4 µm/pixel로 설정하였다. 또한 아크릴 막대 양 옆의 지점은 앞서 3절에서 구한 교정 차트에 의거하여 오차가 5 % 미만이 될 수 있도록 65 µm 이상의 진폭으로 가진을 하였다. 교정 차트에 42 Hz에 대한 정보는 없으므로, 38 Hz와 75 Hz에 대한 결과를 이용해 선형 보간 법을 통해 구하였다. 본 실험의 몇 가지 대표적 결과는 Fig. 8에 나타내었으며, 직선 진동 운동과 회전 진동 운동을 함께 측정할 수 있는 점을 알 수 있다.  는 회전 진동 운동의 진폭을 나타낸다.

는 회전 진동 운동의 진폭을 나타낸다.

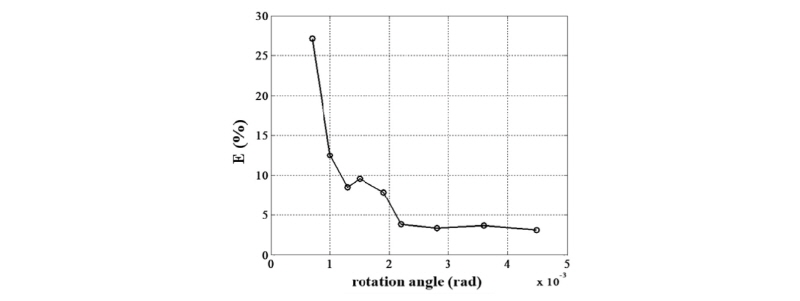

직선 진동 운동의 측정 결과의 정확도가 오차 5 % 이내라는 것을 알기 때문에, 직선 진동 운동의 수치 미분 값을 교정 기준으로 하여 회전 진동 운동의 오차를 계산할 수 있다. 아래 Eq. (6)에서 계산 가능하며, 이를 Fig. 9의 그래프에 나타내었다.

, (6)

, (6)

여기서  는 수치 미분 값,

는 수치 미분 값,  는 직접 측정 값이다. Fig. 9에서

는 직접 측정 값이다. Fig. 9에서  가 0.002 rad 이상일 때는 차이가 5 % 미만의 값을 유지하다가,

가 0.002 rad 이상일 때는 차이가 5 % 미만의 값을 유지하다가,  의 값이 그 이하가 되면 차이가 급격히 커지는 양상을 볼 수 있다. 수치 미분의 값은 5 %의 오차 범위 내에서만 신뢰할 수 있는 값이기 때문에,

의 값이 그 이하가 되면 차이가 급격히 커지는 양상을 볼 수 있다. 수치 미분의 값은 5 %의 오차 범위 내에서만 신뢰할 수 있는 값이기 때문에,  의 값이 작아질수록 점점 아크릴 막대를 이용한 측정값의 오차가 커지는 것이다.

의 값이 작아질수록 점점 아크릴 막대를 이용한 측정값의 오차가 커지는 것이다.

4.2 외팔보의 다중 점 진동 측정

외팔보의 여러 지점에 대한 동시 측정을 수행하기 위해, 다중 표시 점을 이용하여 두 가지 실험을 진행하였다. 먼저 외팔보를 랜덤 신호로 가진하고 이를 카메라로 측정하여 각 지점에서의 주파수 응답 함수를 구하였다. 그 후, 외팔보를 고유 진동수로 가진하고 각 지점의 거동을 시간 영역에서 관찰하고 다음으로 전체 지점의 거동을 한 번에 관찰하였다. 두 실험 모두 앞과 동일한 카메라 설정을 사용하였으며 픽셀 당 실제 거리는 160 µm/pixel로 하였다.

4.2.1 랜덤 가진

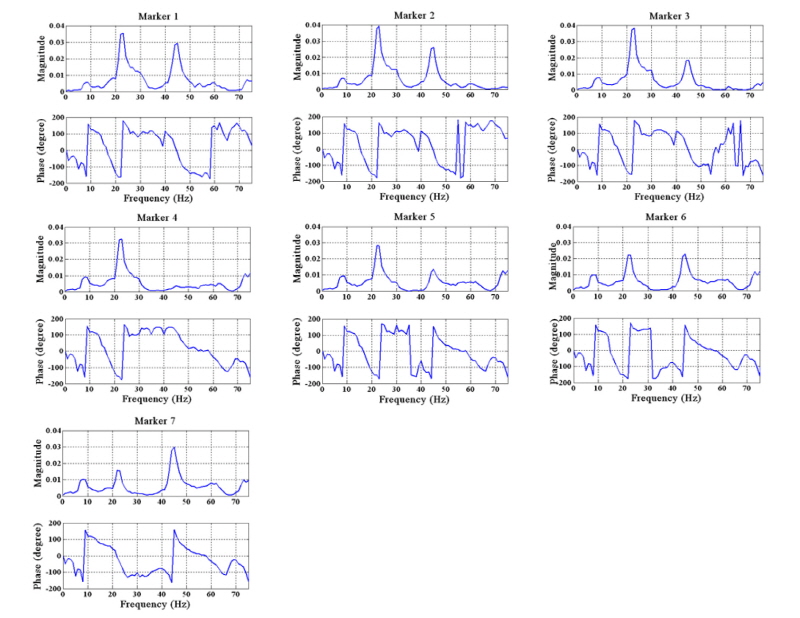

먼저 Fig. 10과 같이 7개의 표시 점을 이용하여 실험을 하였다. 가진 신호로는 0 Hz ~ 75 Hz의 좁은 주파수 대역에서의 랜덤 신호를 사용하였으며, 이에 대한 각 지점에서의 주파수 응답 함수를 구하였다. 주파수 응답 함수를 구하는 데 있어서 카메라와 가진기 힘 센서의 측정 시작 지점, 즉 위상을 맞춰주는 작업이 중요하다. 만약 LDV 등으로 응답 신호를 측정한다면 하드웨어적으로 LDV와 힘 센서를 동시에 트리거링 시킬 수 있지만 카메라의 경우는 그것이 불가능하다. 따라서 트리거링을 위한 LED를 따로 설치하고 이 LED와 힘 센서 그리고 LDV를 동시에 작동시켰다. 이미지에 트리거링을 위한 LED의 불빛이 들어오는 순간이 LDV와 힘 센서가 작동하기 시작하는 순간이므로, 이를 이용해서 응답과 입력의 시작점을 일치시킬 수 있다. 여기서 카메라의 프레임 속도 때문에 최대  s의 위상 차가 발생할 수 있으므로 LDV와 카메라 신호를 보고 보정을 해 주었다. 카메라 측정 신호와 LDV 측정 신호의 최대 값을 나타내는 위치를 이용하여 위상을 보정해주었으며 보정된 위상만큼 힘 센서의 위상도 보정해주었다. 각 표시 점에 대한 주파수 응답 함수 결과는 Fig. 11과 같다. 표시 점1, 2, 3, 5, 6, 7의 경우 8 Hz, 22 Hz, 45 Hz에서 각각 고유 진동수를 나타낸다. 하지만 표시 점 4의 그래프를 살펴보면 45 Hz에서 크기가 피크 점을 나타내지 않고 위상 그래프 역시 큰 변화를 나타내지 않는다. 따라서 표시 점 4의 위치는 외팔보의 3차 고유진동수인 45 Hz의 노드(node) 지점이라는 것을 알 수 있다. 이렇게 여러 개의 표시 점을 이용하면 주파수 영역에서의 해석이 가능하다는 것을 알 수 있다.

s의 위상 차가 발생할 수 있으므로 LDV와 카메라 신호를 보고 보정을 해 주었다. 카메라 측정 신호와 LDV 측정 신호의 최대 값을 나타내는 위치를 이용하여 위상을 보정해주었으며 보정된 위상만큼 힘 센서의 위상도 보정해주었다. 각 표시 점에 대한 주파수 응답 함수 결과는 Fig. 11과 같다. 표시 점1, 2, 3, 5, 6, 7의 경우 8 Hz, 22 Hz, 45 Hz에서 각각 고유 진동수를 나타낸다. 하지만 표시 점 4의 그래프를 살펴보면 45 Hz에서 크기가 피크 점을 나타내지 않고 위상 그래프 역시 큰 변화를 나타내지 않는다. 따라서 표시 점 4의 위치는 외팔보의 3차 고유진동수인 45 Hz의 노드(node) 지점이라는 것을 알 수 있다. 이렇게 여러 개의 표시 점을 이용하면 주파수 영역에서의 해석이 가능하다는 것을 알 수 있다.

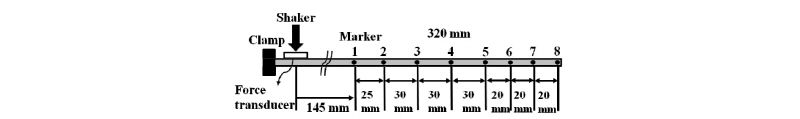

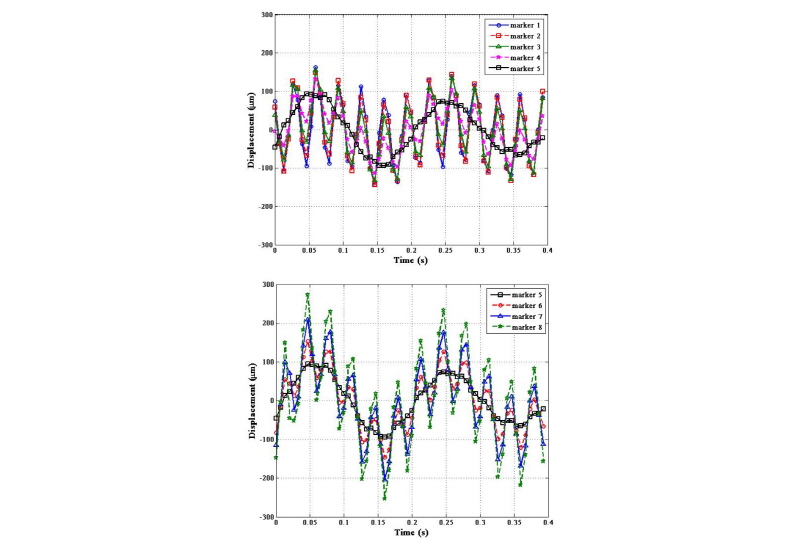

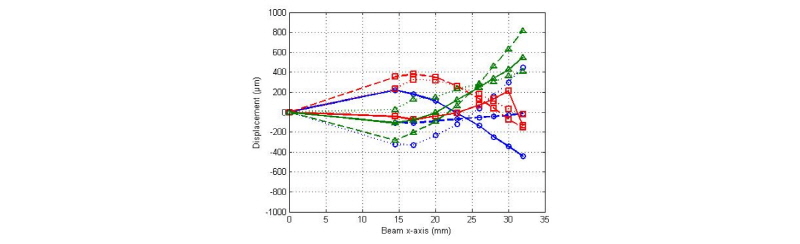

4.2.2 고유 진동수 가진

두 번째 실험은 Fig. 12와 같이 표시 점 8개를 이용하여 실험을 하였다. 첫 번째 실험과 동일하게 먼저 랜덤 가진을 이용하여 주파수 응답 함수를 구했으며, 이를 통해 외팔보의 1, 2차 고유 진동수가 각각 5 Hz, 30 Hz라는 결과를 얻었다. 본 실험에서는 2차 고유 진동수인 30 Hz로 가진하였을 때 각 지점의 시간 축에 대한 변위가 어떻게 되는지 살펴보고 시간에 따른 외팔보의 전체적인 형상을 살펴보았다. 각 표시 점의 시간에 따른 위치는 Fig. 13과 같고 외팔보의 전체 움직이는 형상은 Fig. 14와 같다. 표시 점 1에서 표시 점 4까지는 크기의 차이는 있지만 위상은 모두 동일하다. 표시 점 6에서 8까지 역시 크기의 차이는 있지만 위상은 모두 동일하며, 표시 점 1에서 표시 점 4까지의 위상과 정확히 180°의 위상 차이를 보인다. 표시 점 5에서는 1차 고유진동수인 5 Hz의 진동만 보이고 있으므로 본 위치는 2차 고유 진동수의 노드 지점이라는 것을 알 수 있다. 본 실험을 통하여 여러 개의 표시 점을 이용하면 카메라 측정을 통해 그들 사이의 위상 차를 알 수 있다는 것을 보였으며, 그 정보를 이용하면 시간에 따른 구조물의 전체적 진동 형상을 볼 수 있다는 것을 실험적으로 보였다.

V. 결 론

본 연구에서는 먼저 진동을 측정하기 위해 고려해야 할 카메라의 변수에 대하여 알아보고, 단일 표시 점을이용하여 카메라의 교정을 다중 표시 점을 이용하여 직접 카메라로 여러 지점과 방향의 진동을 한 번에 측정하는 실험을 진행하였다. 이를 통하여 가우시안 곡선 맞춤을 이용하여 표시 점을 추적할 경우 어느 정도의 오차로 진동 측정이 가능한 지 알아보았으며, 이를 이용하여 다중점과 여러 방향 진동의 카메라 측정의 가능성에 대하여 볼 수 있었다. 향후 더 많은 카메라 설정 조건과 진동 진폭과 주파수 조건에 대하여 실험을 진행하여 교정을 일반화시켜 외팔보 이외의 실물의 진동을 측정하는 연구가 필요하다. 본 연구에서는 2차원 진동에 대한 측정을 다루었는데, 만약 카메라를 두 대 이상 사용한다면 3차원 진동 측정으로의 확장 가능성이 있으며 이에 대해서는 추후 더 연구가 필요하다.

, camera measurement;

, camera measurement;  , LDV measurement (a) 80 µm, (b) 60 µm (c) 40 µm (d) 20 µm.

, LDV measurement (a) 80 µm, (b) 60 µm (c) 40 µm (d) 20 µm.

, 5 %;

, 5 %;  , 10 %;

, 10 %;  , 15 %;

, 15 %;  , 20 %. (a) 41.5 µm/pixel, (b) 81.4 µm/pixel, (c) 160 µm/pixel.

, 20 %. (a) 41.5 µm/pixel, (b) 81.4 µm/pixel, (c) 160 µm/pixel.

, measured;

, measured;  , calculated. (a)

, calculated. (a)  = 0.0045 rad, (b)

= 0.0045 rad, (b)  = 0.0028 rad, (c)

= 0.0028 rad, (c)  = 0.0019 rad, (d)

= 0.0019 rad, (d)  = 0.0013 rad.

= 0.0013 rad.

, marker 1;

, marker 1;  , marker 2;

, marker 2;  , marker 3;

, marker 3;  , marker 4;

, marker 4;  , marker 5;

, marker 5;  , marker 6;

, marker 6;  , marker 7;

, marker 7;  , marker 8.

, marker 8.

,

,  s;

s;  ,

,  s;

s;  ,

,  s;

s;  ,

,  s;

s;  ,

,  s;

s;  ,

,  s;

s;  ,

,  s;

s;  ,

,  s;

s;  ,

,  s.

s.